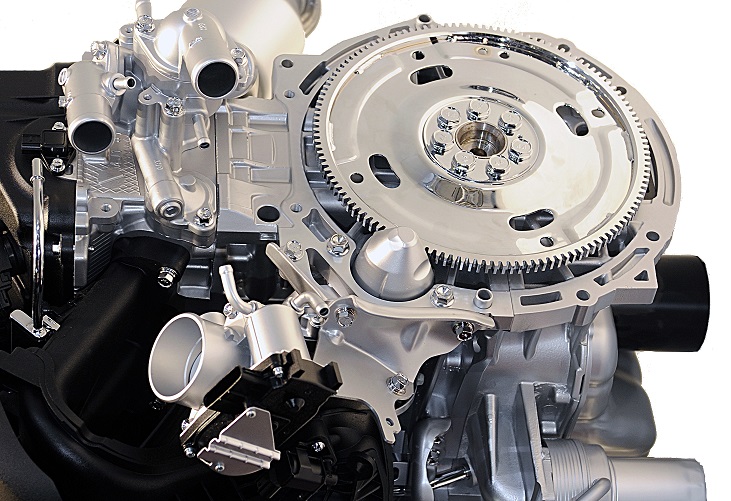

REDEX est une entreprise spécialisée dans la fabrication de machines pour la métallurgie.

Depuis le début de la crise sanitaire que nous connaissons, le groupe a maintenu son activité en s’adaptant au mieux à des contraintes sanitaires et d’organisation inédites.

Après une période où l’entreprise s’est attelée à maintenir son offre, REDEX entre désormais dans une seconde phase, qui va consister à maintenir un niveau de demande suffisant. Interview.

Yves Valentin : Le 16 mars dernier, le Président annonce le confinement généralisé du pays. Quelle est votre réaction à ce moment-là ?

Bruno Grandjean : Le 16 mars, suite à l’annonce du Président, nous avons pris la décision immédiate de ne pas fermer. Ce fut un choix très compliqué. Le ministre de l’économie Bruno Lemaire a, dans les jours qui ont suivi, évoqué les « entreprises indispensables », qui devaient coûte que coûte poursuivre leur activité. Nous nous sommes alors posé la question : est-ce que l’industrie mécanique est indispensable ? En choisissant de fermer, nous savions à quel point cela pourrait engendrer des situations très difficiles, pour nos clients d’abord, qui avaient des commandes en attente. D’une certaine façon nous sommes donc indispensables, tous. Les camions qui livrent des masques aux hôpitaux sont tributaires du garagiste qui va réparer leur outil de travail, par exemple.

Chez REDEX, nous avons livré depuis le début de la crise des composants destinés à des machines pour fabriquer des masques, des respirateurs, du matériel médical… Ce n’est pas l’unique raison pour laquelle nous sommes restés ouverts, mais cela a permis de participer à maintenir au mieux les chaînes logistiques et industrielles du secteur de la santé pendant la crise.

Si nous sommes restés ouverts, c’est aussi et surtout parce que nous avons considéré que les conditions de travail à l’usine, pour autant qu’elles pouvaient être aménagées, étaient compatibles avec la sécurité sanitaire de nos salariés.

Quelles dispositions avez-vous mis en place pour poursuivre l’activité sur site ?

Nous avons bien sûr dû adapter les conditions de travail. Dans les bureaux d’étude notamment nous avons fait le choix d’établir un chômage partiel à 50%, ce qui permet de faire plus de rotations et de mieux gérer l’éloignement.

En ce qui concerne les activités de production, de fabrication et de montage, nous avons conservé durant les premières semaines quasiment 100% de l’effectif. Pour une raison simple : nous n’avons pas eu à subir d’annulations de commandes, l’activité a donc été maintenue.

Ce maintien de l’activité constitue pour moi une prouesse de la part de l’ensemble de l’entreprise, mais tout particulièrement de l’encadrement et du service ressources humaines, qui ont été extrêmement sollicités depuis le début de cette crise. Le service RH a eu un rôle crucial depuis le 16 mars, à savoir rétablir la confiance au sein de l’entreprise. Cela a été le cas dans la plupart des usines de France, il faut, je crois, leur rendre hommage pour cela.

Vous évoquez la confiance des salariés. Comment avez-vous maintenu le dialogue social au sein de l’entreprise pendant cette période ?

Nous avons mis en place un dialogue social constant au sein de l’entreprise dès le départ, via des rendez-vous quotidiens avec le CSE (conseil économique et social) et les représentants du personnel. Cela nous a permis de co-construire les règles sanitaires pour adapter le fonctionnement de REDEX au contexte de la crise Covid-19. Ce qui ne fut pas aisé, il faut se rappeler que les instructions sur les masques, les gels hydroalcooliques, les distances de sécurité, sont longtemps restées très floues. Cela ne facilite pas la mise en place des procédures nécessaires pour assurer la sécurité de nos salariés.

Mais nous avons réussi à collecter les informations nécessaires pour produire notre règlement sanitaire « maison », et cela nous a permis de regagner la confiance de nos salariés, qui ont adhéré très majoritairement.

Cette période a aussi mis en exergue la différence de situation entre les employés travaillant à l’usine et les autres. Les premiers ne peuvent pas télétravailler par exemple, et cela participe à créer un déséquilibre dans la cohésion de l’entreprise. En estimant qu’il y avait une solidarité à maintenir avec les employés qui devaient être physiquement présents, nous avons décidé de ne pas généraliser le télétravail dans l’entreprise durant le confinement, mis à part pour certains postes déjà structurés pour ce type de fonctionnement.

Nous avons donc fonctionné de cette manière pendant les mois de mars et d’avril, en maintenant l’activité à 80%. Rétrospectivement, ce choix difficile de poursuivre l’activité en assurant la sécurité sanitaire a été un bon choix.

Nous avons également eu la chance de faire face à des salariés très responsables, qui ont tout de suite compris la complexité de la situation. Notamment par rapport au danger pour REDEX d’être dans l’impossibilité de répondre aux demandes clients, avec un impact en termes de chiffre d’affaires, mais également de perte de part de marché par rapport à nos concurrents.

D’autant que nos principaux confrères, allemands pour la plupart, ont continué à fonctionner à près de 100% durant les mois de mars et avril. Ne pas poursuivre l’activité nous aurait donc fortement pénalisé, peut-être même de manière irréversible.

Et aujourd’hui, où en êtes-vous ?

Les mois de mars et avril, que je viens d’évoquer, constituent une première phase, pour nous, durant laquelle le défi a principalement été de maintenir notre offre. Aujourd’hui, nous passons à une seconde phase, où nous allons nous évertuer à maintenir un certain degré de demande.

Notre carnet de commandes était relativement important en entrée de crise, mais certaines commandes ont été repoussées voire annulées.

L’enjeu pour nous est donc de réamorcer l’activité et les entrées de commandes.

REDEX est une entreprise qui évolue sur les marchés des composants et des machines dont l’activité repose sur l’investissement. Pour tous les chefs d’entreprises, la priorité numéro une durant cette crise a été de préserver la trésorerie de leurs entreprises. La plupart des investissements ont donc été gelés. C’est ainsi que plusieurs projets sur lesquels nous étions très actifs ont été repoussés pour le moment.

Il faut aussi bien avoir à l’esprit que la crise que nous traversons touche à la fois l’Asie, l’Europe et les Etats-Unis. Pour une entreprise comme REDEX, qui mise énormément sur l’export, voir ses 3 principaux débouchés mondiaux traverser une crise en même temps est une situation totalement inédite.

Comment cela se traduit-il en termes de chiffre d’affaires ?

Nous n’avons pas perdu beaucoup de chiffre d’affaires en mars, avril et mai puisque nous avons continué à produire. Mais aujourd’hui le carnet de commandes se réduit, et nous nous projetons une baisse de 15% de chiffre d’affaires sur 2020 pour l’entreprise.

Il faut cependant rester optimiste. Depuis quelques semaines nous constatons que certains marchés se réactivent progressivement.

Comment vous projetez-vous sur le court et moyen terme ?

Les usines ont besoin d’investissements. Nous sommes par exemple très actifs sur le secteur de la sidérurgie. Pour tourner, il faut avoir conscience qu’une usine sidérurgique nécessite plusieurs millions d’euros d’investissements chaque année. On est en train de retrouver ce niveau minimum d’investissement. C’est un indicateur positif.

Nous avons également vu émerger une tendance chez certains clients à s’orienter vers des reconversions, avec des besoins en termes de nouveaux produits, de nouvelles machines, de modifications de machines… Cela est plutôt encourageant pour notre secteur d’activités.

Notre pari est de tabler sur un retour d’activité correcte à partir de septembre. Et sur un retour au niveau d’activité de 2019 à compter de 2021.

Mais pour l’heure c’est surtout début septembre, au vu de ce qui va se passer dans les prochaines semaines, que nous affinerons nos décisions stratégiques.

On parle beaucoup de relocalisation des outils de production suite à la crise de Covid-19. Qu’en pensez-vous ?

Pour une entreprise comme REDEX, qui produit des biens d’équipements et des machines, un mouvement assez large de relocalisation pourrait se révéler assez favorable. Jusqu’à maintenant, l’industrie a eu tendance à développer majoritairement une stratégie d’optimisation du capital qui, pour faire court, s’illustre par des usines de plus grande taille de moins en moins nombreuses. Si le sens de l’histoire va vers une régionalisation des chaînes de valeurs, cela ne se fera pas sans nouveaux investissements. De la part des Américains par exemple, qui devront construire de nombreuses usines sur leur sol s’ils veulent diminuer les importations asiatiques. La situation européenne est comparable. Il n’est donc pas impossible que nous allions vers un modèle où nous verrons plus d’usines de capacité moyenne, plus proches des consommateurs, plutôt que quelques usines géantes. Ce besoin d’équipements plus important favoriserait notre activité, bien entendu.

Aussi, au vu de tous les plans de relance, nous constatons qu’il y a beaucoup d’argent injecté dans l’économie actuellement. Un de nos clients en Afrique du Sud, gros importateur de matières premières, veut par exemple aujourd’hui plus intégrer sa production. Un programme d’Etat vient le soutenir dans cette démarche visant à baisser le besoin d’importation de certaines matières premières. Il est donc possible qu’un projet voit le jour, entre autres grâce à ces financements, avec des externalités potentiellement intéressantes pour nous.

Plus généralement, quel regard portez-vous sur la situation industrielle française actuelle ?

La crise que nous vivons a permis au grand public de constater qu’un pays, pour être souverain, doit disposer d’une industrie forte. Aujourd’hui, ce n’est pas suffisamment le cas. Nous parlions à l’instant des relocalisations. La France est-elle en capacité de relocaliser certaines productions ? Je ne le pense malheureusement pas. Les délocalisations d’activités sont assez souvent opérées en direction des pays d’Europe de l’Est et du Maghreb, où il y a un tel différentiel en termes de compétitivité/coûts… La France est impuissante sur ce terrain-là.

Sans une politique volontariste pour simplifier les contraintes réglementaires et abaisser la fiscalité, mais aussi regarder les problèmes de compétitivité en face avec les partenaires sociaux, je ne vois pas comment nous pourrons redevenir suffisamment attractifs. Avant d’envisager de relocaliser, il nous faut d’abord surmonter ces handicaps.

Par quoi commencer ?

Il y a un travail de pédagogie immense à faire en France. Le grand public ne se figure pas à quel point l’industrie est une activité complexe et fragile. Notre pays a pris l’option du « fabless ». Nous avons gardé nos centres de recherches, nous faisons produire majoritairement à l’étranger et nous rapatrions les bénéfices dans un modèle d’industrie « offshore ». Il ne s’agit pas à mon sens d’un choix isolé mais plus d’un mouvement collectif, un choix de société. Après l’incendie de l’usine de Lubrizol par exemple, j’ai entendu certaines voix militer pour la fermeture du site, qui produit du lubrifiant. La fermeture du site se traduirait par une dépendance accrue, un appauvrissement de l’économie locale et une production à l’étranger sans doute moins respectueuse des normes environnementales. Le manque de culture technique et économique aboutit à des raisonnements dangereux qui peuvent potentiellement conduire à un déclassement de notre pays.

Au-delà de la pédagogie, quels sont les choix forts à opérer ?

Je pense qu’il y a une grande réflexion à opérer en France sur la vision que nous voulons pour notre industrie, qui n’a pas encore été totalement engagée. Par exemple, une étude économique démontrait qu’une relocalisation des productions à faible valeur ajoutée – masques, textiles… – aboutirait en France à une baisse du pouvoir d’achat de l’ordre de 16%. Qui est prêt à cela ? Il ne faut donc pas se tromper d’objectif. Ce sont les productions à forte valeur ajoutée qu’il faut faire revenir en France. Prenons l’exemple de la 5G. Comment se fait-il qu’en France, où nous avons eu une filière télécom importante, nous sommes aujourd’hui dans l’incapacité de fabriquer nos propres équipements pour la 5G ? Nous allons importer des équipements alors même que nous avons conscience de l’importance de rester souverains sur tous les domaines touchant au numérique. Miser sur nos atouts, élaborez des stratégies à l’échelle de l’Europe, axées sur le long terme, en connectant recherche et industrie, favorisant l’entrepreneuriat et la prise de risques, voilà ce qui me semble être la priorité.

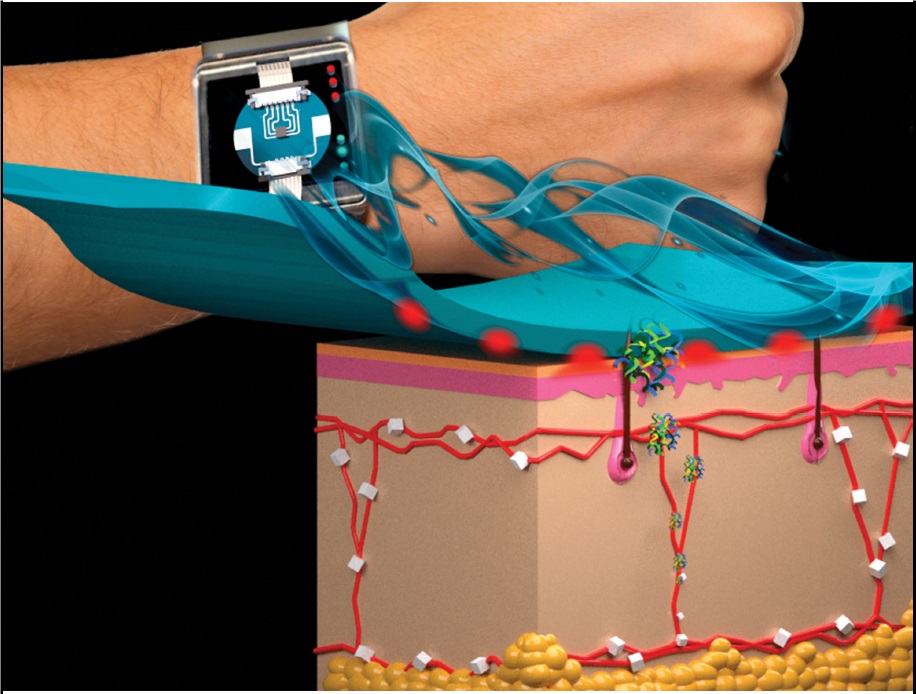

Vous parliez de choix forts. Vous avez mis en place dans votre entreprise le principe des « jumeaux numériques ». Le confinement a-t-il imposé cette démarche ?

Le confinement a obligé toutes les entreprises à improviser, afin de trouver des solutions à des problématiques qui n’avaient pas forcément été anticipées. Les jumeaux numériques par exemple, que nous savions être un sujet important avant le confinement, s’est imposé naturellement. Nous avons réussi à mettre en route certains équipements à distance grâce à ces technologies numériques, alors qu’il fallait au maximum limiter les déplacements de nos salariés. Si nous étions déjà convaincus de la pertinence de cette approche, le confinement nous a permis de passer à la vitesse supérieure sur ce sujet.

Nous allons désormais investir sur le développement de jumeaux numériques pour toutes nos machines.

Aussi bien en termes de maintenance que de suivi des machines, cela va nous permettre d’avoir un contrôle beaucoup plus poussé sur nos machines. Aussi, en termes humains, nous allons économiser beaucoup de déplacements liés à l’exploitation ou à la maintenance des machines.

L’automatisation de nos ateliers, que nous avions engagée depuis un moment, s’est également révélée être un atout majeur pour maintenir la production.

Le développement de jumeaux numériques vous oblige-t-il à revoir vos procédés liés à la sécurité informatique de l’entreprise ?

Il y a bien sûr des précautions à prendre en compte, mais la sécurité informatique est déjà un sujet que les entreprises traitent tous les jours. La réticence qui pouvait exister, chez nous comme chez nos clients, à partager des données, a volé en éclats lors de cette crise sanitaire. Simplement car nous n’avions pas le choix. C’est une immense avancée qui a été opérée à cette occasion, et il n’y aura pas de marche arrière sur ce sujet selon moi. D’ailleurs, plus généralement, je pense que la période que nous avons vécue depuis le mois de mars constitue pour beaucoup d’entreprises un pas de géant vers l’industrie du futur.

Propos recueillis par Yves Valentin, directeur général de Techniques de l’Ingénieur, et Pierre Thouverez, journaliste.

Mes 25 ans d’expérience de direction générale dans le domaine de la

Mes 25 ans d’expérience de direction générale dans le domaine de la