Techniques de l’Ingénieur vous propose un tête-à-tête avec quatre de ces scientifiques[1], pour évoquer à la fois leur carrière, et leur vision de la place des femmes dans le monde de la recherche scientifique. Pour le troisième entretien de cette série, partons cette fois à la rencontre de la lauréate sud-africaine de ce prix L’Oréal-UNESCO Pour les Femmes et la Science 2025 : la professeure Priscilla Baker, récompensée pour ses travaux de développement de microcapteurs électrochimiques aux multiples applications.

Professeure de chimie et co-directrice de laboratoire au sein de l’Université du Cap-Occidental, en Afrique du Sud, Priscilla Baker est l’une des grandes figures du domaine de la chimie analytique. Attirée par les sciences depuis son plus jeune âge, elle s’est d’abord intéressée à l’océanographie, avant d’être contrainte – dans le contexte sociopolitique particulièrement rude de l’époque – de se tourner vers sa deuxième passion, la chimie analytique. Un vaste domaine dans lequel elle s’est plus particulièrement intéressée au sujet des microcapteurs électrochimiques, avec l’ambition d’œuvrer d’abord et avant tout pour le bien-être général. Une volonté qui s’est traduite par le développement de microcapteurs destinés à une large palette d’applications altruistes, de la surveillance de pollutions environnementales, à la sécurité alimentaire, en passant par le diagnostic médical précoce de maladies telles que le diabète, les troubles cardiaques, ou encore la tuberculose. Outre son travail remarquable, la professeure Priscilla Baker témoigne aussi de sa capacité à surmonter l’adversité à laquelle elle a été confrontée en tant que femme subissant, en outre, la politique ségrégationniste sud-africaine.

Techniques de l’Ingénieur : Qu’est-ce qui vous amenée à consacrer votre carrière à la chimie analytique ?

Priscilla Baker : J’ai toujours su que je voulais faire des sciences, tout simplement pour le défi que cela représentait. J’étais une enfant très têtue ! Je remettais toujours les choses en question. C’est ce qui m’a amenée, au départ, à m’orienter vers les sciences, un domaine que je savais difficile, mais dont j’étais curieuse de voir où il me mènerait. Mais, outre mon côté obstiné, d’autres facteurs ont aussi, dans une moindre mesure, contribué à mon choix de faire des sciences.

Au sein de l’école publique dans laquelle j’ai étudié, nous n’étions qu’un petit groupe d’élèves à suivre les enseignements scientifiques, ce qui nous a permis de bénéficier pleinement des ressources de notre établissement, avec aussi, en toile de fond, un petit côté élitiste… Or, la société sud-africaine était à l’époque très stratifiée…

Je devais d’ailleurs initialement passer mon matric [équivalent du baccalauréat français, n.d.l.r.] en 1985, mais cette année-là, nos examens ont été annulés à cause des troubles politiques qui ont frappé l’Afrique du Sud. Nous n’avons pu le passer que l’année suivante, en 1986.

J’ai alors pu entrer en licence, à l’Université du Cap, où j’ai suivi, pendant mes deux premières années, des cours scientifiques assez généraux, de physique et de mathématiques notamment. Ces bases m’ont ensuite permis d’accéder à un nouvel enseignement proposé à l’université : un cours d’océanographie physique[2]. J’ai sauté sur l’occasion de découvrir cette discipline nouvelle pour moi, qui m’a d’emblée paru passionnante.

D’ailleurs, tout était nouveau pour moi à l’université ! Pour des personnes de couleur comme moi, c’était la première fois que nous avions la possibilité de nous inscrire à la fac sans avoir à rédiger de lettre de motivation. Ce sont toutes ces petites avancées qui ont permis de donner un coup d’accélérateur à mon parcours, en me faisant prendre conscience que je pouvais le faire !

J’ai peu à peu découvert à quel point les sciences pouvaient être enrichissantes et stimulantes. Notamment le concept d’erreur en chimie analytique, qui est tout simplement fascinant.

Malheureusement, l’océanographie ne m’a pas menée bien loin… À l’époque, en effet, le contexte politique ne permettait pas aux femmes et aux personnes de couleur de monter à bord des navires de recherche.

Je me suis donc tournée vers ma deuxième spécialité, la chimie analytique. Cela a été le point de départ de la carrière[3] que j’ai poursuivie jusqu’à aujourd’hui.

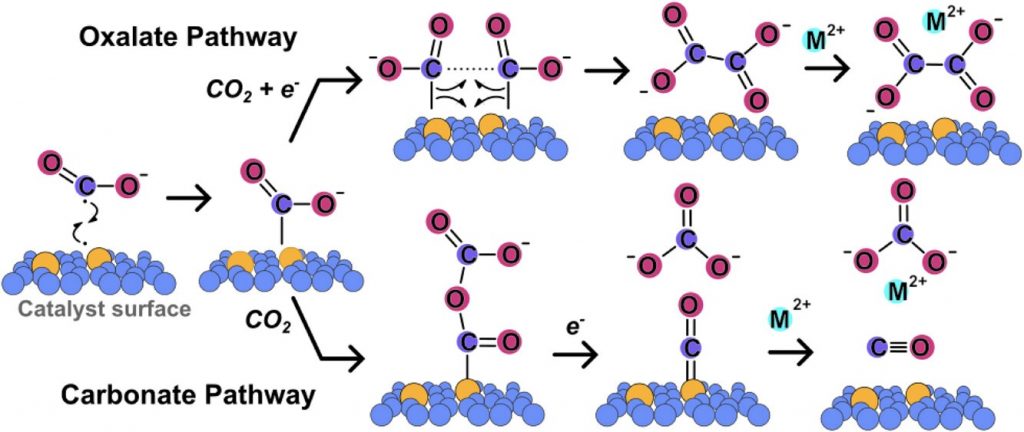

Vous vous êtes plus particulièrement intéressée au domaine des microcapteurs électrochimiques. De quoi s’agit-il précisément ?

Les microcapteurs électrochimiques sont des dispositifs semi-conducteurs qui peuvent être intégrés à l’interface avec des solutions, mais aussi l’air, voire des surfaces solides.

Fondamentalement parlant, de par la nature électrochimique de ces capteurs, leur fonctionnement repose sur la mesure du mouvement des électrons au sein des systèmes, qui permet ainsi d’en révéler les caractéristiques : la nature chimique des molécules qui les constituent par exemple, ou encore la cinétique de ces systèmes. Ces capteurs peuvent en outre aujourd’hui être imprimés, et intégrés par exemple à des vêtements.

Ils peuvent donc trouver de multiples applications : mesures environnementales, énergétiques, ou encore physiologiques, dans le domaine de la santé, pour la surveillance de maladies non transmissibles. C’est d’ailleurs un domaine d’application majeur ici, en Afrique du Sud : de nombreuses maladies non transmissibles sont en effet étroitement liées au contexte historique, social et économique du pays. Beaucoup de ces pathologies sont la conséquence de nos modes de vie. Or, l’organisation du système scolaire a fait que beaucoup de personnes n’ont, par exemple, pas bénéficié de l’éducation nécessaire en matière d’alimentation.

Si vous ne deviez retenir que quelques exemples d’applications concrètes issues de vos travaux, lesquelles citeriez-vous ?

Au sein du laboratoire que je co-dirige à l’Université du Cap-Occidental – le SensorLab –, mon équipe et moi-même avons, par exemple, développé un capteur capable de détecter précocement la troponine, une protéine du muscle cardiaque dont la libération dans le sang est un signe de détérioration du cœur, et, in fine, d’infarctus du myocarde. Grâce à sa sensibilité, ce capteur permet ainsi une détection bien plus précoce qu’avec un électrocardiogramme d’un potentiel trouble cardiaque. Cela permet donc au patient d’adopter des mesures préventives, à commencer par un rééquilibrage alimentaire.

Nous avons fait de même avec l’acide urique. Cette substance est bien connue car, en excès, elle cause la goutte, une inflammation des articulations. Mais ce que l’on sait moins, c’est qu’elle peut aussi, à moindre concentration, être associée à la dépression chez certaines personnes. On pourrait donc tout à fait imaginer faire bénéficier ces capteurs à des personnes souffrant de dépression, afin de prévenir l’apparition de la goutte.

Plus largement, certains de mes étudiants se penchent aussi sur des applications dans le domaine du système endocrinien, d’autres travaillent plus spécifiquement sur le diagnostic de maladies cardiaques, du diabète ou encore de la tuberculose. Ce travail sur la tuberculose en particulier est d’ailleurs le fruit de notre collaboration avec CY Cergy Paris Université, en France.

Tout cela nous rend très enthousiastes, cette maladie, comme toutes les autres que j’évoquais d’ailleurs, touchant un grand nombre de personnes… Cela illustre clairement à quel point la technologie peut avoir des effets palpables et positifs sur la société.

Cependant, aujourd’hui, l’évolution des techniques est telle qu’une bonne partie du travail de réflexion est déléguée aux machines. J’ai donc à cœur de sensibiliser mes étudiants au danger que représente cette logique de « boîte noire ». Certes, les instruments sont de plus en plus intelligents, mais nous ne devons pas compter sur eux pour penser à notre place ! L’IA est par exemple quelque chose de formidable, mais ne doit pas nous contraindre à sacrifier cette capacité de raisonnement que nous avons au profit de la productivité ou du succès à tout prix.

Comment accueillez-vous ce Prix International L’Oréal-UNESCO Pour les Femmes et la Science qui vous a été décerné le 12 juin dernier ? Pensez-vous que votre exemple puisse inciter d’autres femmes, et plus particulièrement des jeunes filles en âge scolaire, à se lancer elles aussi dans une carrière scientifique ?

C’est un véritable honneur ! J’espère que mon exemple pourra aider la prochaine génération de femmes scientifiques. Notre valeur, en tant que femmes et scientifiques, ne se mesure pas, en effet, au nombre de fois où nous sommes sur le devant de la scène, mais plutôt aux scènes que nous contribuons à construire afin d’y mettre les autres en avant.

[1] La cinquième lauréate de cette 27e édition était absente pour raisons de santé lors de cette cérémonie du 12 juin 2025.

[2] Priscilla Baker est la première femme africaine à avoir obtenu une licence en océanographie physique à l’Université du Cap.

[3] Priscilla Baker est devenue, en 2003, la première universitaire à temps plein nommée au département de Chimie de l’Université du Cap-Occidental.