Le changement climatique vient exacerber les événements extrêmes en termes d’intensité et de fréquence. C’est ce qu’affirme le rapport du groupe de travail chargé des éléments scientifiques de l’évolution du climat (groupe I) du GIEC (Groupe d’experts intergouvernemental sur l’évolution du climat) publié en août 2021. De nombreuses régions vont être touchées, au niveau mondial. Les contributions des groupes II (conséquence, adaptation et vulnérabilité) et III (atténuation du changement climatique) arriveront respectivement en février et mars 2022.

Pour mieux comprendre le lien entre les événements extrêmes et le changement climatique, ainsi que leur niveau de prévisibilité, nous avons échangé avec Françoise Vimeux, climatologue à l’Institut de Recherche pour le Développement (IRD) et Pascal Yiou, chercheur au Laboratoire des Sciences du Climat et de l’Environnement (LSCE).

Techniques de l’Ingénieur : Qu’est-ce qu’un événement extrême ?

Françoise Vimeux : Ce qu’on appelle événement extrême, climatique ou météorologique, c’est un événement dont l’intensité sort de la gamme usuellement observée. Ce sont les vagues de chaleur, les sécheresses, les pluies torrentielles, mais également les cyclones. Cependant, la définition d’un événement extrême n’est pas la même par exemple en France ou au Sahel où les températures estivales sont déjà beaucoup plus élevées en moyenne. On qualifie donc d’extrême un événement en fonction du territoire sur lequel il se produit.

Quel est le lien entre changement climatique et événements extrêmes ?

F. V. : De nombreuses études montrent qu’un certain nombre d’événements extrêmes sont attribués au changement climatique. Ils n’auraient jamais eu lieu dans un climat non modifié par l’homme avec une telle intensité. Les vagues de chaleur, les sécheresses et les pluies torrentielles sont exacerbées par le changement climatique à la fois en termes de fréquence et d’intensité.

L’atmosphère et l’océan se réchauffent, et donc nos étés vont être de plus en plus chauds, et des événements exceptionnels particulièrement chauds sont attendus. Le rapport du GIEC explique par exemple qu’une vague de chaleur qui avait lieu tous les 50 ans sur la période 1850-1900, arrivera une fois tous les 10 ans dans un monde à +1,5°C à la fin du siècle, et presque une fois par an si l’anomalie de température est de +4°C en 2100.

L’augmentation de l’intensité des pluies torrentielles quant à elle vient du fait qu’une atmosphère plus chaude peut contenir plus de vapeur d’eau (7 % de plus par degré de réchauffement). Ainsi, une situation météorologique qui conduira à des pluies entraînera des cumuls de pluie plus importants et des risques d’inondations plus forts. Enfin, pour les sécheresses, certaines régions comme la Méditerranée vont être soumises à des déficits de pluies importants, et à une forte évaporation des sols à cause des températures élevées.

Pascal Yiou : Et pour les vagues de froid, même si les températures augmentent, elles ne disparaîtront pas. En effet, il s’agit d’air venant des pôles qui sont plus froids que nos latitudes, même s’ils se réchauffent plus vite. Ces vagues de froid seront moins fréquentes pour les moyennes latitudes, mais pas moins intenses.

Qu’en est-il des cyclones ?

F. V. : C’est un peu différent pour les cyclones. Les simulations climatiques nous disent qu’il n’y aura pas plus de phénomènes cycloniques, d’ailleurs il y en aura probablement moins dans certains bassins océaniques. Cependant, on sait que le risque cyclonique va augmenter pour plusieurs raisons.

Tout d’abord, pour un nombre de phénomènes constants, il y aura davantage de cyclones intenses, de catégorie 4 et 5, que de cyclones de catégorie 1 à 2. Dans le bassin Atlantique, on commence à parler de cyclone quand la vitesse des vents moyens est supérieure à 119 km/h (catégorie 1), et les catégories s’étalent jusque 5 avec vents supérieurs à 251 km/h. Dans l’océan indien, la classification est un peu différente et on nomme l’état du système dépressionnaire, par exemple : dépression tropicale, tempête tropicale, cyclone, cyclone intense et très intense, etc. Chacune de ces dénominations est définie par des vents minimum et maximum.

Ensuite, pour la raison évoquée ci-dessus, les cyclones seront plus pluvieux et cela engendrera de graves inondations.

Enfin, le risque de submersions marines lors d’un cyclone va être intensifié par la montée du niveau moyen des mers. Lorsque vous avez une dépression atmosphérique (tempête ou cyclone), cela crée une légère élévation des mers localement. Si, dans 50 ans, la mer a un niveau moyen de 20 cm au-dessus de celui d’aujourd’hui, on aura une submersion marine augmentée de 20 cm pour une dépression de même intensité. Ainsi, on peut craindre des submersions marines plus importantes, même pour des cyclones de faible catégorie.

Cet été, nous avons observé de nombreux événements extrêmes dans le monde. Est-ce un avant-goût de l’avenir ?

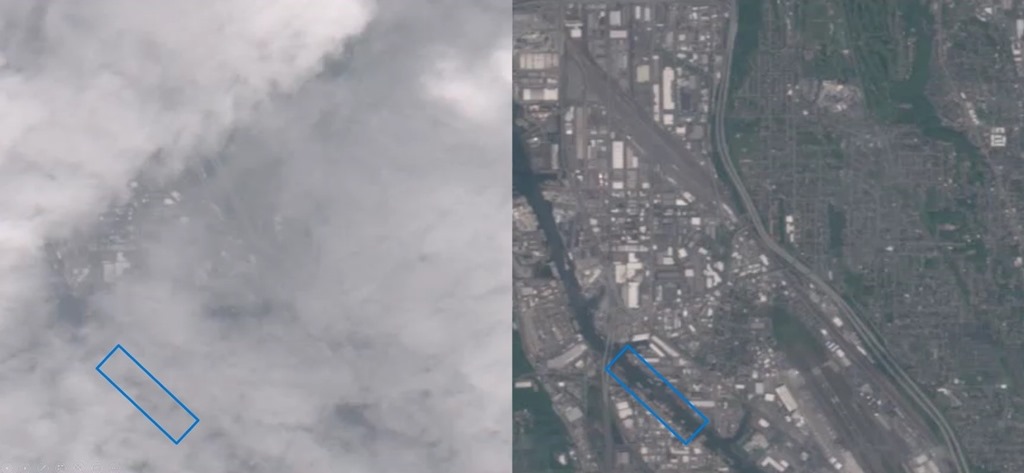

F. V. : C’est vrai que cet été, il y a eu beaucoup d’événements extrêmes dans l’hémisphère nord. Nous avons tout eu : dôme de chaleur dans le nord des États-Unis et au Canada, vagues de chaleur qui ont entraîné des feux en Californie, en Grèce et en Algérie, pluies torrentielles en Allemagne et en Belgique. Le record mondial de température a même été battu en juillet dans la vallée de la Mort [au désert des Mojaves, aux Etats-Unis, NDLR] avec un thermomètre affichant 54,4°C ! C’est un panel terrifiant, mais assez représentatif de ce qu’on peut attendre car, en effet, la fréquence de ces événements extrêmes va augmenter. Cependant, cela ne signifie pas que nous aurons tous les ans autant d’événements extrêmes.

En fait, il y a toujours eu des événements extrêmes par rapport à un climat donné. La canicule que l’on a connue en 2003 était un événement extrême car elle sortait de la variabilité connue pour les températures estivales à cette époque. Lorsqu’on regarde les projections climatiques, en 2050, l’été 2003 entrera dans la catégorie d’un « été normal ». En termes d’intensité, un événement extrême des années 2000 ne sera plus considéré comme tel au milieu du siècle ! Quand tous les ans vous avez la même vague de chaleur, on ne peut plus dire que c’est un événement extrême… Cela devient un événement classique.

Peut-on prédire les événements climatiques ?

P. Y. : Il existe deux formes de prédiction : la prévision météorologique et la projection climatique. Pour la première, il s’agit de déterminer la probabilité qu’un événement dangereux comme les cyclones ou les vagues de chaleur se produise dans les heures ou jours à venir. On sait le faire depuis longtemps et les modèles deviennent meilleurs avec le temps. Pour la seconde, on va plutôt se demander si de tels événements seront plus ou moins fréquents dans le futur. Et cela dépend du type d’événement, comme l’a expliqué Françoise Vimeux.

On va se demander également si ces événements extrêmes deviennent plus prédictibles d’un point de vue météorologique. L’exercice consiste à se placer dans un monde plus chaud, à la fin du 21e siècle par exemple : si la condition observée le 2 décembre 2021 se produit en 2071, est-ce que je peux dire que l’hiver sera très froid ? Est-ce que le temps dont nous disposons pour nous adapter change avec le changement climatique ? La réponse est oui, en fonction des événements. Les tempêtes seront plus faciles à prédire par exemple, les vagues de froid également.

Qu’est-ce qui les rend plus faciles à prédire ?

P. Y. : Les propriétés météorologiques de l’atmosphère changent avec le changement climatique. À l’heure actuelle, l’atmosphère est très « nerveuse », mais le sera bien moins à la fin du 21e siècle. Qu’est-ce que cette nervosité ? En moyenne latitude, nous avons un jet-stream, un courant d’air rapide qui se situe dans l’atmosphère, piloté par la différence de température entre l’équateur et le pôle. On peut l’imaginer tel un serpentin qui fait le tour de la planète. C’est la vitesse à laquelle ce serpentin va onduler qui va créer des événements météorologiques, comme les anticyclones persistants l’été dernier dans l’Ouest américain. Avec le changement climatique, la différence de température entre l’équateur et le pôle décroît : les pôles se réchauffent plus vite. La force et la direction de ce courant-jet dépendent de ce gradient de température, ce qui impacte directement la météorologie des moyennes latitudes où nous vivons.

Quels sont les outils utilisés pour réaliser ces prédictions ?

P. Y. : D’un côté il y a les matériaux, comme les observations, les simulations numériques ou modèles climatiques, et de l’autre les outils : comment calculer leurs probabilités. On utilise beaucoup de modèles physiques, comme ceux utilisés dans les rapports du GIEC, mais ils sont compliqués à mettre en œuvre car ils nécessitent des calculateurs et sont très coûteux. Une cinquantaine de simulations mobilisent des calculateurs à temps plein. Cinquante, ce n’est pas beaucoup, mais c’est le mieux que l’on puisse faire à l’heure actuelle.

Pour dépasser cette barrière, mon équipe développe des modèles statistiques dont le comportement ressemble à ce modèle météorologique ou climatique, pour de petites zones. Nous n’explicitons pas les principes physiques moteurs (comme les mouvements de l’atmosphère), mais nous avons quelque chose qui ressemble à la réalité en termes de température ou précipitation. On va utiliser le maximum de données qui correspondent au climat dans lequel on vit, comme les observations au sol et par les satellites, mais également les simulations météorologiques et climatiques. L’objectif est d’avoir une couverture globale. Au lieu de 50 simulations, nous en faisons des dizaines de milliers, ce qui permet de mieux appréhender les distributions de probabilités des variables climatiques.

Qu’est-ce que cela permet ?

P. Y. : C’est une façon de valider un demain possible. Par exemple, on veut calculer la probabilité qu’il fasse beau demain. Il existe de nombreux « demains » possibles, comme il existe de nombreuses fins de siècle possibles. La question que l’on se pose est : en quoi tous les demains possibles que l’on calcule vont ressembler au demain que l’on observera ? Nous avons besoin de quantifier, de donner un degré de ressemblance entre les deux. On va à la fois s’intéresser à la probabilité qu’il fasse beau, mais surtout, à la probabilité que les probabilités soient bonnes.

Y a-t-il eu une évolution technologique dans les outils de prédiction ?

P. Y. : L’évolution est constante, mais il s’agit surtout d’une évolution conceptuelle sur l’utilisation de l’intelligence artificielle pour avoir des émulateurs permettant de multiplier les expériences à bas coût informatique et éviter de saturer les mémoires. Notamment l’utilisation de méthodes proches de l’IA et de concepts mathématiques liés à la théorie du chaos.

L’un des gros chantiers à l’heure actuelle, et qui est en croissance depuis ces dix dernières années, est le calcul de l’évolution de probabilité d’occurrence d’un événement extrême, et comment le changement climatique affecte cette occurrence. Ces recherches ont conduit à des évolutions technologiques, au développement de modèles statistiques, notamment pour déterminer l’attribution d’un événement extrême au changement climatique. C’est un passage obligé même si la causalité au changement climatique est difficile à établir. On peut cependant regarder si la probabilité a changé avec le changement climatique.