Comme de nombreux pays, la France projette de déployer une application mobile de “contact tracing” permettant le traçage des personnes entrées “en contact” des malades atteints du Covid-19. “Par « contact tracing », on désigne la capacité à pouvoir informer une personne, à travers une application présente sur son smartphone, qu’elle a été au contact lors des jours précédents (typiquement de deux à trois semaines) de personnes qui ont été diagnostiquées positives au Covid-19, explique Bruno Sportisse, PDG d’Inria dans une longue déclaration sur le site de l’institut. Ce « cas contact » présente, de ce fait, un risque d’être porteur du virus et d’accélérer la diffusion de l’épidémie”. L’application génère régulièrement des pseudonymes (des codes aléatoires composés de chiffres et de lettres), qu’elle transmet via la technologie Bluetooth lorsque deux smartphones sont à proximité (quelques mètres). Son utilisation est basée sur le volontariat et l’anonymat des individus.

Pour permettre le développement d’une telle application, différents protocoles de communication – des procédures décrivant comme une application doit fonctionner – ont été mis au point par des spécialistes de la sécurité : PACT (par le MIT), DP-3T (par les écoles fédérales de Lausanne (EPFL) et Zurich (ETHZ)), Apple/Google et le dernier, publié la semaine dernière, ROBERT (d’Inria et AIESEC de Fraunhofer).

L’ensemble de ces propositions garantit la sécurité de la vie privée des utilisateurs. Dans ces propositions, les approches diffèrent sur la façon dont les pseudonymes sont gérés : décentralisé pour DP-3T, PACT et Apple/Google et centralisé pour ROBERT. Derrière ce dernier protocole, l’équipe-projet StopCovid qui vient, le 26 avril, de se structurer pour développer l’application française StopCovid. Celle-ci, menée par Inria, rassemble des acteurs multidisciplinaires français : ANSSI, Capgemini, Dassault Systèmes, Inserm, Lunabee Studio, Orange, Santé Publique France et Withings.

Deux approches : centralisée et décentralisée

Un groupe de chercheurs spécialisés dans la cryptographie (University of Canada, CNRS, Inria, EPFL) a réalisé une analyse de risque du traçage des individus des protocoles précédemment cités. Qu’il s’agisse de l’approche centralisée ou décentralisée, “ces deux modèles comportent des avantages et des inconvénients. Le modèle centralisé nécessite de faire confiance à une autorité centrale. […] Le modèle décentralisé ne pose a priori pas ce problème, mais ouvre la porte à certaines attaques”, explique le groupe.

En effet, “la vie privée des gens atteints du Covid-19 est un peu plus à risque car des attaques de dé-anonymisation sont possibles, ajoute Sonia Ben Mokhtar, directrice de recherche au Laboratoire d’informatique en image et systèmes d’informations (LIRIS) du CNRS. Lorsqu’une personne se déclare infectée, elle va diffuser des pseudos qu’elle a utilisés avec des informations temporelles à gros grain (par exemple, jour J dans la matinée). Des adversaires vont pouvoir potentiellement recouper l’information”. Par exemple, comme illustré par le groupe d’experts en cryptographie, plusieurs voisins qui ont reçu l’alerte vont pouvoir se dire que la personne infectée se trouve dans l’immeuble et non dans leur monde professionnel.

Dans le modèle centralisé de ROBERT, “le choix s’est porté sur une solution où un serveur central fait le matching des personnes à risque”. La personne qui est diagnostiquée Covid-19 va envoyer anonymement les pseudos qu’elle a rencontrés. Le serveur central va changer le statut de ces pseudos en les notant “à risque”. Un utilisateur de l’application, qui se demande s’il a croisé une personne qui a le Covid-19 peut questionner le serveur. “Bien sûr, ajoute Sonia Ben Mokhtar, il faut des garanties de sécurité sur le serveur en lui-même. Mais je fais entièrement confiance à l’équipe Privatics [Inria, NDLR] pour mettre en place les mécanismes nécessaires afin de sécuriser le serveur et garantir les propriétés nécessaires aux usagers.”

Du code en open-source

Le code des protocoles publié en open-source permet à des experts de regarder ce qui a été réalisé par les équipes de recherche. “L’open-source est indispensable, affirme Sonia Ben Mokhtar. Quand on dit que les données ne sont pas stockées, c’est vraiment le cas. Ou quand elles seront supprimées au bout de 14 jours, elles le seront. Une communauté scientifique est mobilisée sur la question, et propose des améliorations sur le site”. Et si une personne malveillante venait s’emparer du code ? “Si on s’en tient à l’application officielle, auditée par de nombreuses personnes, la fuite de données est assez faible, explique Gaëtan Le Guelvouit, responsable laboratoire confiance et sécurité chez B<>com. Par contre, il est possible de faire une copie de l’application et d’y ajouter des portes dérobées. Mais avec l’application officielle, le risque est assez faible.”

Google et Apple au centre ?

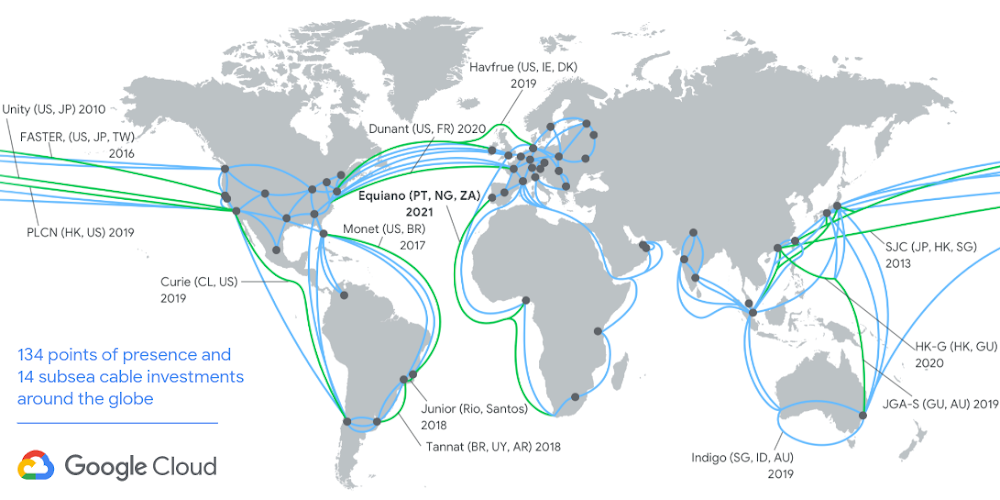

Pour permettre aux applications de fonctionner plus efficacement, Google et Apple ont annoncé leur partenariat afin de développer des interfaces de programmation (API) disponibles pour les développeurs. Le problème est que ces applications développées par le gouvernement ne peuvent fonctionner en tâche de fond et doivent obligatoirement rester actives et affichées à l’écran. Ce qui empêche son propriétaire de l’utiliser pour une autre tâche, et utilise beaucoup de batterie. Autre problème, La première version de la solution Apple/Google, qui est attendue pour le 28 avril, s’interfacera bien avec le protocole décentralisé DP-3T mais pas avec le centralisé ROBERT. Les négociations sont en cours.

La question de la dépendance à ces géants du numérique a été soulevée par le patron de Sigfox, Ludovic Le Moan, dans un entretien accordé aux Echos. Pour lui, quelle que soit l’application, elle passera forcément par Apple et Google. “On parle beaucoup des applis de tracing, mais je veux mettre en garde. Les Gafa savent déjà qui on est, ce qu’on fait et quel type de publicité ils peuvent nous pousser pour maximiser leurs revenus. Mettre, demain, dans leur système d’exploitation une technologie qui dévoile qui est avec qui à quel moment, c’est encore un pan de liberté qui va nous échapper et des données supplémentaires pour Apple et Google…”. Il prône un bracelet indépendant du téléphone, moins intrusif que le smartphone.

Quid de l’acceptabilité ?

Hormis le choix important du protocole de communication qui sera intégré dans l’application, une question importante reste en suspens… Qu’en sera-t-il des utilisateurs ? “Il y a de vrais enjeux sur l’acceptabilité de ces applications par nos sociétés, affirme Sonia Ben Mokhtar. Il faut expliquer aux gens quels sont les risques et quelles sont les garanties offertes en termes de sécurité et de préservation de la vie privée. De nombreux systèmes qui manipulent nos données personnelles (données de mobilité, données de santé) sont « centralisés ». Par exemple, les réseaux sociaux, les systèmes manipulant nos données bancaires, notre dossier médical partagé. Je ne comprends pas pourquoi la centralisation de ces données ne fait pas polémique alors que celle d’une application comme StopCovid (qui offre un certain nombre de garanties : anonymisation, encryption des données) créé autant de réticences”. Un collectif de scientifiques et de professionnels de santé affirme d’ailleurs, dans une tribune publiée dans Le Monde, que StopCovid serait un outil indispensable contre la diffusion du virus.

Pour le groupe d’experts en cryptologie, le rapport bénéfices-risques ne semble pour le moment pas pencher pour les applications : “A notre connaissance, l’estimation des bénéfices d’un éventuel traçage numérique est aujourd’hui encore très incertaine, alors même que les scénarios que nous avons développés ici [dans leur rapport, NDLR] sont, eux, connus et plausibles”.

La Cnil se prononce

Cependant, le 26 avril, la CNIL a donné son accord au développement de cette application, sous conditions. “La CNIL estime que l’application peut être déployée, conformément au RGPD, si son utilité pour la gestion de crise est suffisamment avérée et si certaines garanties sont apportées. En particulier, son utilisation doit être temporaire et les données doivent être conservées pendant une durée limitée. La CNIL recommande donc que l’impact du dispositif sur la situation sanitaire soit étudié et documenté de manière régulière, pour aider les pouvoirs publics à décider ou non de son maintien.”

Si l’adoption de ce dispositif est votée suite au débat du Parlement, prévu le 28 avril, la CNIL émet des recommandations sur l’architecture et la sécurisation de l’application : “L’ensemble de ces précautions et garanties est de nature à favoriser la confiance du public dans ce dispositif, qui constitue un facteur déterminant de sa réussite et de son utilité”. Le compte-à-rebours s’accélère, la décision devrait être prise dans les jours à venir…

Bien avant que l’application StopCovid ne soit un sujet brûlant, la médecine connectée s’est révélée salutaire dès les premiers jours de la crise sanitaire liée au Covid-19. Télésurveillance, téléconsultation, dépistage en ligne, plateformes de recrutement de personnel soignant… Des

Bien avant que l’application StopCovid ne soit un sujet brûlant, la médecine connectée s’est révélée salutaire dès les premiers jours de la crise sanitaire liée au Covid-19. Télésurveillance, téléconsultation, dépistage en ligne, plateformes de recrutement de personnel soignant… Des

La formation en

La formation en

Dans un

Dans un

Selon PlasticsEurope, l’

Selon PlasticsEurope, l’