Selon la Première ministre, ce projet lauréat de France 2030 DEMIBaC, préalablement instruit par l’ADEME, s’inscrit pleinement dans la stratégie d’accélération de la décarbonation de l’industrie fixée par la Stratégie Nationale Bas Carbone (SNBC).

L’objectif de neutralité carbone de l’industrie, inscrit dans la SNBC, impose une transformation profonde des modes de production, puisqu’il faudra atteindre une baisse de 81 % des émissions de CO2 d’ici 2050.

D’après le communiqué de presse annonçant le démarrage du projet, le remplacement de 1 000 chaudières industrielles par cette nouvelle technologie permettrait d’éviter l’émission de 4 millions de tonnes de CO2 par an[1].

Quel est le fonctionnement de cette chaudière d’un nouveau genre ?

Le processus est décrit dans une présentation fournie par le consortium[2] et disponible à cette adresse.

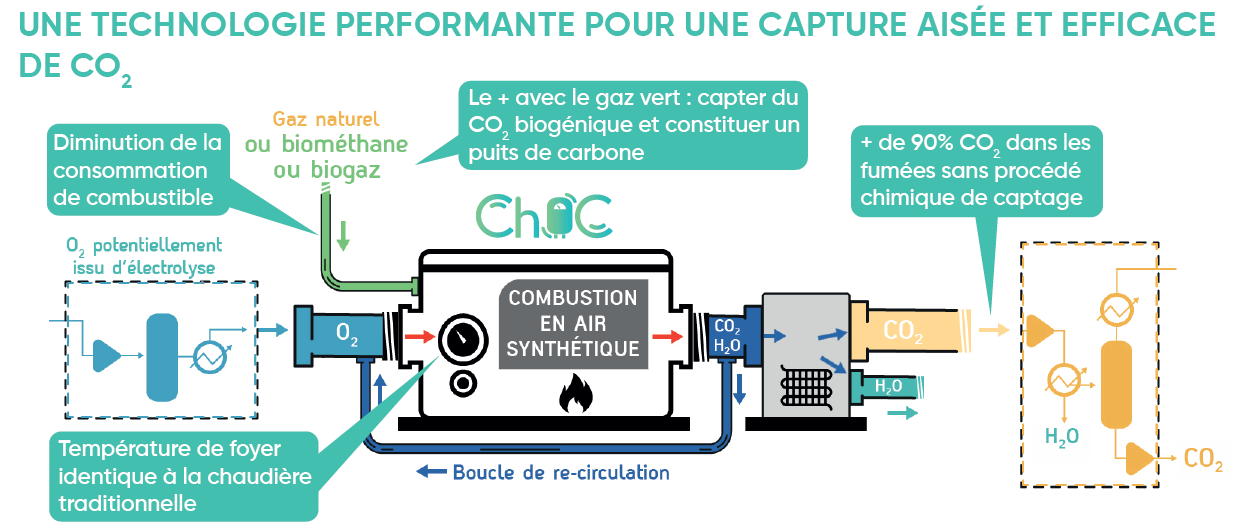

À l’heure actuelle, les chaudières industrielles fonctionnent par aérocombustion. La principale innovation de la chaudière Ch0C repose sur le principe d’oxycombustion, c’est-à-dire le remplacement de l’air, lors de la combustion, par de l’oxygène.

En utilisant de l’oxygène (potentiellement produit par électrolyse), la chaudière fait entrer très peu d’azote dans le système.

Grâce à une boucle de recirculation, les deux tiers des produits de combustion sont réinjectés dans le brûleur, formant un air synthétique composé en grande majorité d’O2, de CO2 et d’H2O.

Après élimination de l’eau en sortie, cela conduit à une concentration du CO2 qui facilite sa récupération et évite jusqu’à 90 % des émissions de CO2 dans l’air.

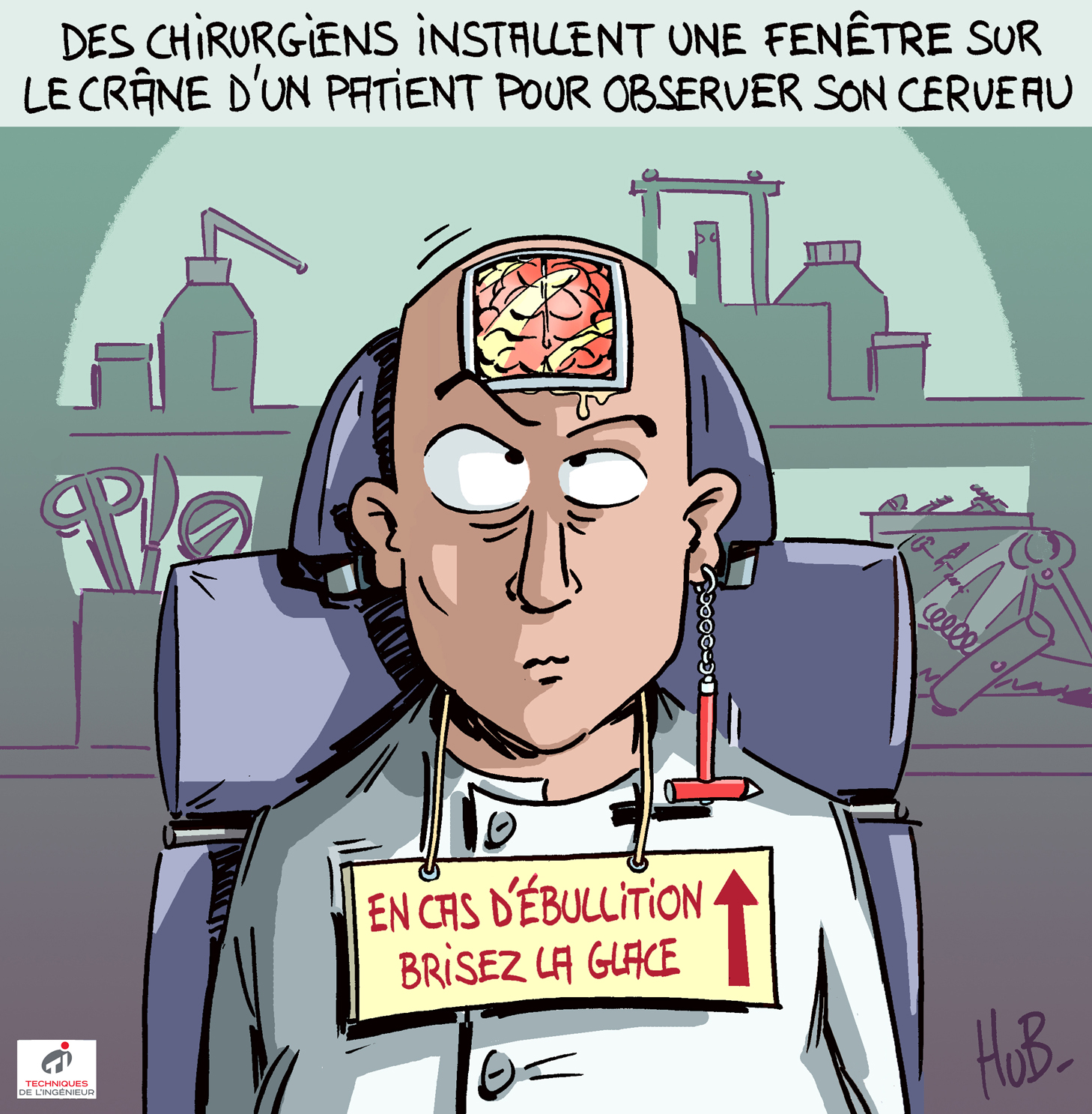

La chaudière Ch0C présente plusieurs avantages.

- Capture aisée du CO2 : les fumées captées en sortie contiennent au minimum 90 % de CO2, sans utiliser de procédés chimiques.

- Technologie maîtrisée : la température du foyer est identique à celle d’une chaudière industrielle traditionnelle.

- Compatible avec les biogaz : les industriels qui le souhaitent peuvent aussi utiliser du biométhane.

- Une consommation en combustible réduite.

Une technologie qui soutient le développement de la filière des énergies décarbonées

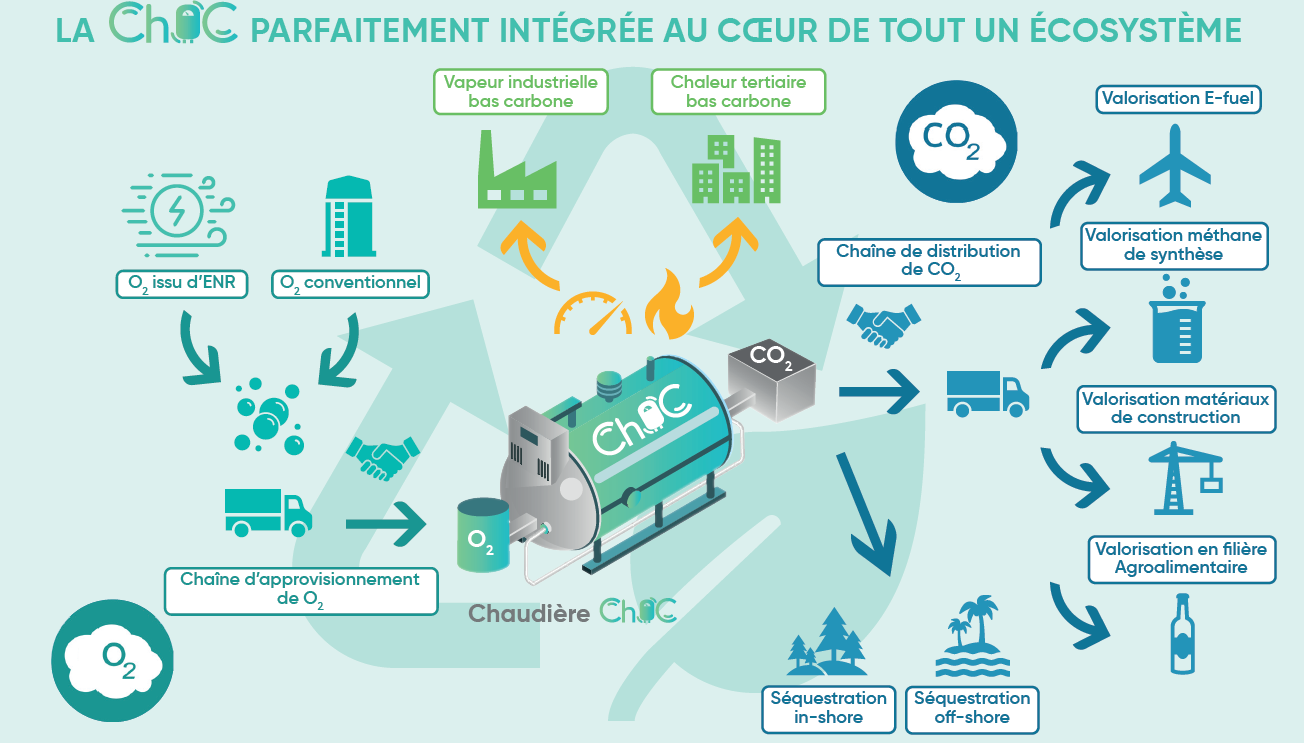

La Ch0c permet à la fois de soutenir la filière de production du biométhane et de créer de nouveaux débouchés pour la valorisation du CO2. Voilà pourquoi elle s’inscrit dans le cadre de l’appel à projets DEMIBaC de l’ADEME, dont le but est de développer des briques technologiques et des démonstrateurs qui associent l’offre et la demande.

Par sa polyvalence, cette chaudière d’un nouveau genre permettra d’accroître progressivement la part du biogaz dans le mix énergétique. C’est donc une technologie pertinente pour accompagner la transition énergétique des industriels, car un approvisionnement suffisant en gaz vert permettrait à terme de transformer la chaudière en puits de carbone.

Pour ce qui est du CO2 produit par la chaudière, l’objectif est d’offrir des opportunités de valorisation aux industriels. À l’heure actuelle, trois types d’industries sont concernées :

- les industries agroalimentaires consommatrices de CO2 ;

- les plateformes industrielles ;

- les industriels grands émetteurs.

Une commercialisation dès 2025 ?

Le projet porté par Naldeo Technologies & Industries (qui assure la coordination de l’ingénierie) est déjà à un stade avancé, puisque la livraison du démonstrateur de 3MW est prévue pour début 2024.

La conception et l’assemblage de la chaudière seront réalisés par Bancock Wanson et Fives fournira son système de combustion Pillard®.

Le système de captage/liquéfaction du CO2 fabriqué par Verdemobil Biogaz, sera également livré avec la chaudière, sur le site industriel de Villers-Saint-Paul (60) exploité par Engie Solutions.

S’ensuivra une phase d’essais qui pourrait aboutir à une commercialisation rapide, dès 2025 !

[1] Avec les hypothèses suivantes : 1 000 chaudières à gaz de 3MW fonctionnant 7 000 h/an ; consommation de gaz associée : 21 TWh (milliards de kWh) ; réduction de 90 % des émissions de CO2 directes liées à cette consommation par rapport à une chaudière gaz classique.

[2] Composé de GRDF, GRTGaz, Total Energies, Engie, Verdemobil Biogaz, Coca-Cola Europacific Partners, Agro-Mousquetaires, Agrial, Bonduelle, Constellium, Babcock Wanson, Naldéo, Fives Pillard, Carboneo, Université de Paris