Vivien Robert et Flore de Lasteyrie sont tous les deux diplômés d’un master en Data Science à CentraleSupélec. Dans un contexte de marché de l’électricité en pleine mutation, ils ont identifié que certains secteurs industriels n’exploitaient pas toutes les données de leurs usines pour réduire leurs factures énergétiques, qui ne cessent de grimper ces derniers mois, ainsi que pour limiter leur impact sur l’environnement. Ils ont développé un logiciel qui analyse les données des usines et qui calcule le coût énergétique de chaque décision prise sur la manière de piloter les systèmes de production. Il y a deux ans, ils ont créé la société Highcast, qui a notamment été sélectionnée pour être membre du Club Start-Up de la FIM (Fédération des Industries mécaniques). Entretien avec les deux fondateurs de Highcast, respectivement CEO et CTO de cette entreprise.

Techniques de l’Ingénieur : Quel est le nouveau contexte auquel sont confrontés les industriels, en matière d’électricité ?

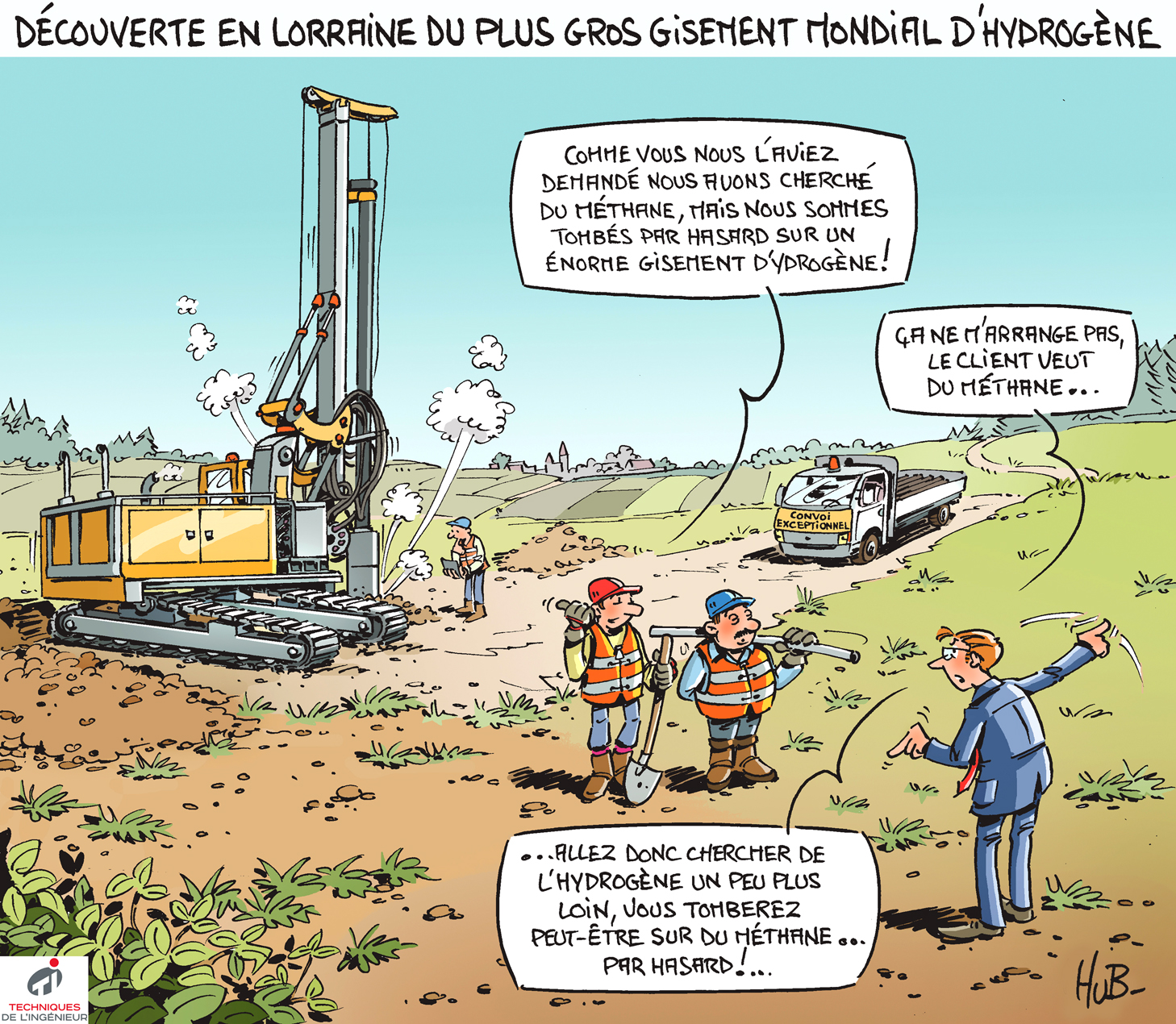

Vivien Robert : Leur facture a beaucoup augmenté ces derniers mois, et ceux qui consomment beaucoup d’électricité, que l’on appelle des électro-intensifs, doivent trouver des solutions pour la réduire. Les industriels sont confrontés à un marché de l’énergie en pleine évolution et doivent faire face à une grande fluctuation du prix de l’électricité. Ces fluctuations sont liées à l’arrivée des énergies renouvelables (solaires et éoliennes), qui sont par nature intermittentes, et qui rendent le réseau plus difficile à équilibrer. Étant donné que les fournisseurs d’électricité ont des difficultés à proposer des contrats à un prix fixe et abordable aux industriels, ils leur proposent souvent un contrat à prix variable, afin qu’ils supportent une partie du risque. Le prix de l’électricité varie alors heure par heure, et peut même devenir négatif, lorsqu’il y a peu de demande et beaucoup de production d’électricité. Dans ce cas, les industriels sont payés pour consommer de l’énergie. À l’inverse, lorsqu’il y a beaucoup de demande et peu de production, le prix de l’électricité devient très élevé.

Face à ce nouveau contexte, quelles solutions proposez-vous aux industriels ?

Flore de Lasteyrie : Aujourd’hui, il existe de nombreux logiciels d’efficacité énergétique, qui permettent d’analyser les données des machines pour essayer d’optimiser leur consommation. Nous nous situons à un niveau au-dessus, en nous intéressant à la planification des usines, notamment lors des périodes de production et de maintenance, qui influencent directement la consommation électrique. Face à la forte fluctuation du prix de l’électricité, les industriels ont intérêt à changer leur manière de conduire leurs systèmes de production, en incluant également la consommation d’énergie, et non plus uniquement des variables comme le taux de rendement.

Nous avons développé un logiciel qui récolte les données de production des usines et les analyse grâce à des algorithmes d’apprentissage automatiques, afin de comprendre quelles sont les conséquences des choix de planification sur la consommation électrique. En parallèle, notre logiciel modélise les données spécifiques du contrat du fournisseur d’énergie et fait également des prévisions de prix de l’électricité grâce à des informations sur le marché. Au final, nous sommes capables de calculer le coût électrique des choix de planification de l’usine. Ces prévisions de consommation sont très fiables et réalisées heure par heure, sur un horizon allant d’un jour à plusieurs semaines à l’avance. Ainsi, lorsqu’une usine réalise des scénarios de planning de production, elle peut savoir quel sera le profil de consommation et le coût énergétique de ses décisions.

Pouvez-vous nous donner des exemples d’applications ?

Flore de Lasteyrie : Lorsque nous intervenons dans une usine, notre objectif dans un premier temps est d’aller chercher les victoires rapides, c’est-à-dire de procéder à des changements qui ne vont pas bouleverser l’ordre établi, mais qui auront un impact fort en termes de réduction de la facture. Cela nous permet de construire la confiance en notre solution avec les industriels et de leur prouver sa pertinence pour intégrer le coût énergétique dans les choix de planification.

Par exemple, une fonderie lance chaque jour une quarantaine de fusions pour chauffer du métal, et chacune d’entre elles dure une vingtaine de minutes. Le moment où elles sont déclenchées provoque des pics d’appels de puissance importants, et cela va déterminer le profil de consommation de l’usine. Grâce aux données analysées par notre logiciel, nous pouvons décaler de quelques minutes à quelques dizaines de minutes ces lancements de fusions, sans que cela ne change quoi que ce soit à la planification de la production, mais tout en permettant de réduire la facture énergétique.

Autre exemple avec le secteur de papeterie qui utilise des machines très énergivores. Une seule d’entre elles peut consommer l’équivalent du quart d’une ville comme Metz. Quand ces machines s’arrêtent, comme c’est le cas lors d’opérations de maintenance, cela a un impact considérable sur le réseau. En analysant les données d’une usine, nous avons remarqué qu’il y avait une certaine flexibilité sur l’horaire de ces maintenances, et qu’elles pouvaient être décalées facilement de quelques heures, sans grandes conséquences sur l’organisation interne de l’entreprise, mais tout en ayant un fort impact sur le coût énergétique.

Quelles sont les gains réalisés à la suite de votre intervention ?

Vivien Robert : En moyenne, la facture énergétique diminue de 5 à 10 %, voire plus dans des secteurs soumis à de fortes fluctuations de consommation d’énergie, comme c’est le cas des fonderies. Dans des usines très consommatrices, notre solution peut représenter plusieurs millions d’économies chaque année.

Ensuite, nous aidons également les usines à consommer une énergie plus verte, en favorisant la consommation lorsque l’énergie est principalement solaire, éolienne ou nucléaire, car c’est à ce moment-là qu’elle est la moins chère.

Notre intervention permet aussi de réduire la pression sur le réseau géré par RTE (Réseau de Transport d’Électricité) et au final de favoriser le mix énergétique français le plus vert possible. Il faut en effet savoir qu’en cas de tension en France, des centrales polluantes au gaz ou au charbon sont allumées.

Enfin, nous pouvons aider les fournisseurs d’électricité à ajuster leurs offres et leurs demandes, en leur envoyant tous les jours les prévisions de consommation électrique des usines à la maille horaire. Ils sont très intéressés par ces prévisions, car cela leur permet d’anticiper la consommation future de leur portefeuille de clients. L’industriel y trouve également son compte, puisque cela lui donne accès à des conditions préférentielles du prix de l’électricité.

Où en êtes-vous dans le développement de votre entreprise ?

Vivien Robert : Nous travaillons avec des premiers clients dans le secteur de la fonderie et de la papeterie, chez qui nous testons notre logiciel. Le marché est en évolution importante, ce qui fait que nous avons beaucoup de demandes en ce moment. Nous nous adressons à toutes les entreprises qui ont un coût de l’électricité significatif dans leurs charges, et où il est pertinent d’intervenir sur la planification. Cela concerne entre autres les secteurs de la métallurgie au sens large, de la papeterie et de la cartonnerie, de la cimenterie et de la verrerie. L’avantage de notre solution est qu’elle représente un investissement limité pour les entreprises et qu’elle est rapide à mettre en œuvre, avec des résultats qui peuvent être conséquents en termes de réduction de la facture électrique.