Créée en 1953, Gesip est une organisation experte en sécurité industrielle, qui fédère plus de soixante entreprises collaborant pour améliorer la prévention et la sécurité des sites industriels et logistiques.

Aujourd’hui Gesip propose des formations, des audits, des guides techniques et des prestations de service aux professionnels de l’industrie et logistique visant à améliorer leurs performances en termes de sécurité.

Aujourd’hui Gesip propose des formations, des audits, des guides techniques et des prestations de service aux professionnels de l’industrie et logistique visant à améliorer leurs performances en termes de sécurité.

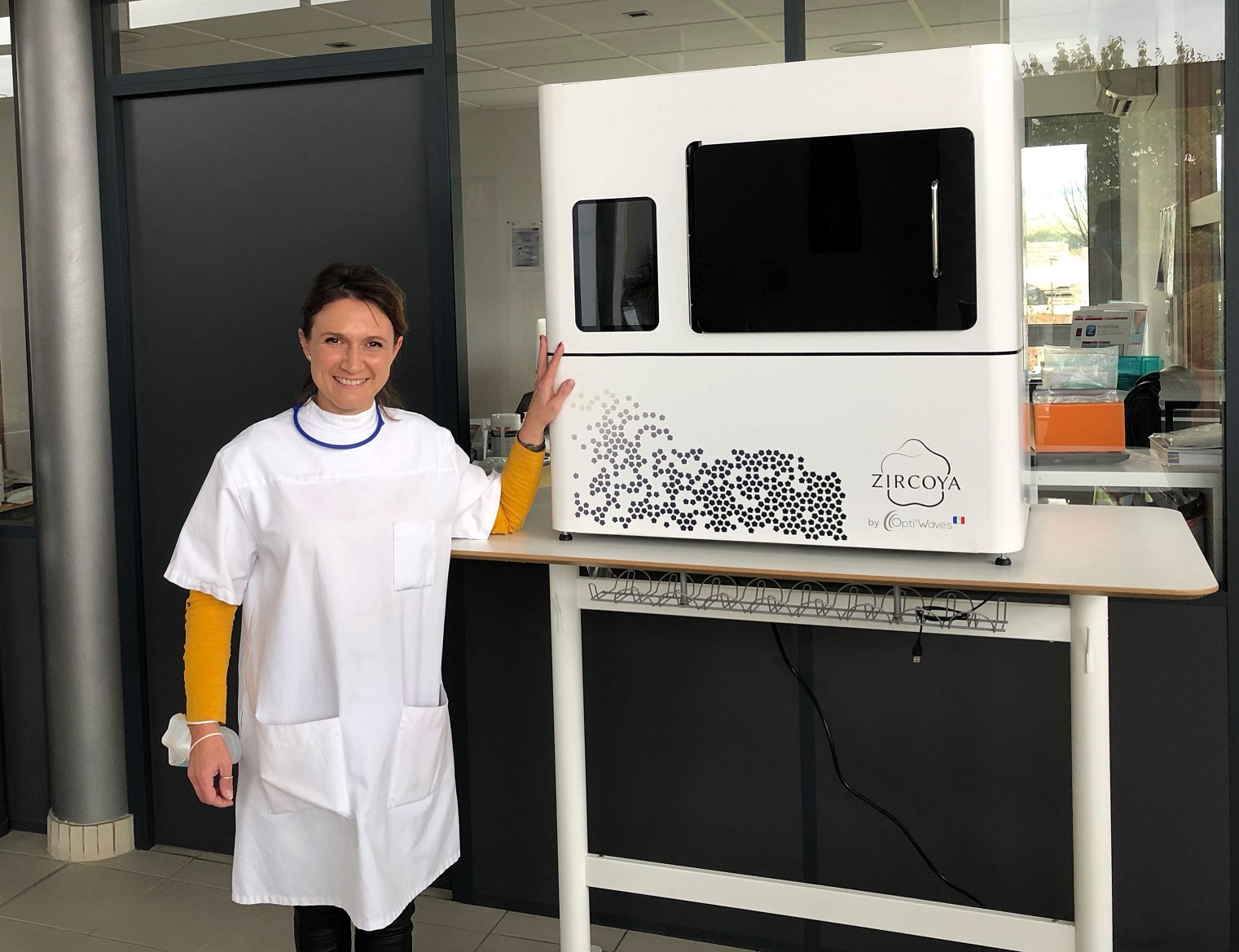

Hélène Moumrikoff, déléguée générale de Gesip, a expliqué aux Techniques de l’Ingénieur comment s’articule cette démarche d’amélioration continue, notamment à la lumière des évolutions réglementaires actuelles.

Gesip partage d’ailleurs son expertise avec l’administration dans le cadre de ces nouvelles réglementations, qui seront progressivement mises en place à partir de janvier 2021.

Techniques de l’Ingénieur : Quels sont les services proposés par Gesip autour de la prévention du risque sur les sites industriels ?

Hélène Moumrikoff : Nous concentrons notre mission sur l’expertise en entreprise et la formation en situation réelle. Gesip accompagne aussi de nombreuses entreprises en missions d’audit et de conseil pour l’élaboration et l’évaluation de plans d’urgence, de systèmes de management de la sécurité et d’installations de défense incendie. Nous œuvrons dans le domaine de la maîtrise des risques toxiques, incendie, explosion et la gestion de crise. Notre vocation est de contribuer à améliorer les performances sécurité et de promouvoir une culture HSE forte.

Comment s’articule la demande de vos clients pour garantir la sécurité de leurs sites industriels ?

La maîtrise des risques passe par la connaissance des évènements et le partage des expériences. C’est ce que nous favorisons au sein de notre organisme. Gesip renforce la sécurité industrielle par la transmission des savoirs grâce à la formation et l’expertise. Dans le cadre de nos missions d’audit et de conseil, l’actualité, les mises à jour réglementaire, les innovations techniques guident les demandes de nos clients et adhérents.

Prenons l’exemple du POI (plan d’opération interne) : il est destiné à gérer et encadrer les situations de crise. Il définit l’organisation, les méthodes d’intervention, d’information des autorités et les moyens nécessaires, en cas d’accident, pour le maîtriser, protéger les personnes, les biens et l’environnement.

Les sites SEVESO seuil haut et bientôt seuil bas ainsi que ceux désignés par arrêté préfectoral doivent établir un POI avant la mise en service de leur site. Ainsi, chaque industriel concerné est dans l’obligation d’appliquer un POI adapté à sa structure. Une mise à jour doit être faite tous les 3 ans et des tests réalisés tous les ans pour les sites SEVESO seuil haut. Les industriels devront en particulier mettre à jour leur POI et GESIP les accompagne dans cette démarche.

Comment l’évolution des réglementations a-t-elle fait évoluer vos missions ces dernières années ?

Nous travaillons avec les industriels dans le cadre de groupes d’échange et d’étude, au sein desquels Gesip recueille les positions des meilleurs experts sur les sujets de sécurité industrielle au cœur de l’actualité.

Reconnue par les autorités, l’expertise et la neutralité de Gesip permettent de retrouver nos guides méthodologiques cités comme références dans des textes règlementaires. C’est par exemple le cas pour ceux concernant les POI ou les pipelines.

Dernièrement, Gesip a également été sollicité par plusieurs syndicats professionnels pour élaborer un guide technique, « Accès des véhicules ADR à motorisation GNL/GNC au poste de chargement/déchargement de marchandises dangereuses ».

Nous participons actuellement aux consultations, menées par le ministère de la transition écologique et solidaire, sur les projets de modification des six arrêtés des textes ministériels, qui encadrent l’utilisation et le stockage des liquides inflammables.

Pourriez-vous nous donner un exemple concernant une évolution réglementaire et la façon dont Gesip l’appréhende ?

Dans le domaine des émulseurs, Gesip dispose d’un protocole de test agréé suivant l’arrêté du 3 octobre 2010 modifié, qui est reconnu par l’administration pour sélectionner des émulseurs particulièrement performants.

L’équipement des installations incendies avec de tels émulseurs permet à la fois à l’industriel de s’assurer de l’efficacité de ses moyens de défenses contre l’incendie tout en diminuant substantiellement ses quantités d’émulseurs stockés.

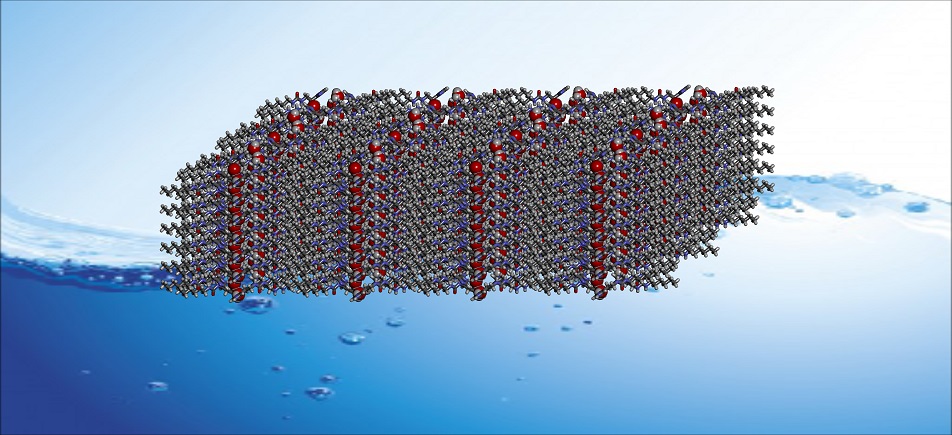

La réglementation concernant des émulseurs va être modifiée en lien avec l’évolution des connaissances technologiques et environnementales. En effet les émulseurs à base de fluor contiennent des surfactants fluorés qui permettent l’insertion d’un film entre la mousse et le liquide enflammé. Celui-ci permet à la fois une meilleure couverture et une progression plus rapide de la mousse. Aujourd’hui, ils sont donc les plus performants en extinction. Néanmoins, il est devenu évident que les composés perfluorés tels que le PFOS et le PFOA sont extrêmement persistants dans l’environnement et des études toxicologiques ont établi un lien entre ces substances chimiques et la survenue d’effets néfastes graves sur la santé de l’être humain. Ces produits et substances associés ont été introduits dans la liste des polluants organiques persistants dont l’utilisation doit être progressivement abandonnée. Ces molécules ont été peu à peu remplacées par des composés perfluorés à chaîne plus courte, qui ne font pour l’instant l’objet d’aucune restriction, mais il est probable que cela finisse par être le cas.

Pour cette raison, les fabricants d’émulseurs anti-incendie investissent dans le développement de nouveaux émulseurs sans fluor améliorés. Il s’agit d’un grand défi, car les domaines à haut risque tels que l’industrie chimique et pétrochimique ont besoin de disposer d’émulseurs aux meilleures performances. À l’heure actuelle, les fabricants mettent au point de nouvelles générations d’émulseurs sans fluor hautement performants et adaptés pour diverses applications.

Avant d’être mis sur le marché, ces nouveaux émulseurs doivent être testés sur des feux réels dans des conditions les plus proches possibles de la réalité. Or, à ce jour, il n’existe pas dans le monde, d’infrastructure permettant de tester leur efficacité sur des feux réels de grande dimension. Dans le but de toujours améliorer la sécurité industrielle, Gesip a construit une cuvette de 300 m² destinée à tester l’efficacité de ces nouveaux émulseurs dans ses installations basées sur son site de Vernon.

Les dimensions hors norme de cette cuvette de 50 mètres de long sur 6 mètres de large permettront d’étudier la progression de ces nouvelles mousses sur de grandes distances en présence ou non d’obstacle afin de simuler des scénarios de feu de nappes représentatifs. Cette cuvette permettra aussi de tester de nouveaux matériels d’extinction sur de grands feux.

Vous parliez tout à l’heure des réglementations mises en place depuis Lubrizol. Gesip a apporté son expertise à l’administration dans la préparation de ces réglementations. Pouvez-vous nous en parler ?

Un retour d’expérience a été fait sur l’incendie survenu il y a plus d’un an : un travail important d’analyse a été réalisé par différentes sociétés, mais aussi à travers l’enquête de la commission sénatoriale. Ces événements, aussi regrettables soient-ils, constituent la source d’un apprentissage et de nouvelles connaissances. Les industriels s’approprient l’ensemble de ces connaissances et l’administration fait évoluer les textes réglementaires.

Gesip se positionne toujours sur un plan technique. Ces textes réglementaires sont rédigés par l’administration française, et comme cela se fait régulièrement sur des sujets techniques comme celui-ci, les syndicats professionnels sont sollicités pour la relecture de ces textes. Gesip peut également être sollicité, si le sujet du texte fait partie de notre champ d’expertise.

Il est important de noter que l’amélioration de la sécurité industrielle et les évolutions réglementaires se font de façon continues même si cela est mis plus en lumière lors d’incident fortement médiatisé.

Quelle est votre mission ?

Notre rôle est de participer à la relecture de ces textes et s’assurer de leur bonne compréhension par les industriels. Nous avons été associés pour ce travail, ce qui nous a permis de répondre aux interrogations des industriels que nous fédérons. La situation était particulière, il faut bien le reconnaître : l’administration française à souhaiter avancer le plus rapidement possible sur les évolutions réglementaires pertinentes, à la lumière de ces nouvelles connaissances. Ceci, afin de répondre aux attentes fortes de la population.

Concrètement, les syndicats professionnels – Gesip, le Medef, entre autres – se sont coordonnés de façon extrêmement rapide pour procéder à la lecture de ces textes et transmettre les questions à l’administration pour qu’elle puisse y répondre directement. Nous avons entre autres pour mission de faire remonter à l’administration des suggestions, qu’elle est libre de retenir, ou pas, puisqu’elle reste totalement maîtresse de décider ce qu’elle entend faire.

Quoi qu’il en soit un dialogue se met en place : nous avons eu beaucoup de réunions avec les différents représentants de la DGPR, pour travailler à la compréhension de ces textes, et actuellement nous sommes en cours de rédaction d’un guide méthodologique.

A l’issue de ce travail, qui n’est pas terminé, nous mettrons en place des formations à distance ou en présentiel, en fonction des conditions sanitaires, pour donner une compréhension et une explication orale des points les plus importants dans le cadre de ces changements.

L’accident de Lubrizol a également fait émerger un besoin d’accès à l’information plus important venant des riverains, et des populations alentour. Comment améliorer ce point ?

La communication avec les riverains existait déjà dans le cadre de la prévention des risques, mais les évolutions technologiques doivent nous conduire à repenser ces transferts d’informations. Je donne un exemple : il y a 20 ans, tout le monde n’était pas équipé d’un téléphone portable. Aujourd’hui on peut trouver plusieurs smartphones dans chaque foyer, on peut donc tout à fait imaginer des moyens de communications plus rapides – envois de SMS massifs, l’usage des réseaux sociaux. Ce sont toutes ces nouveautés qu’il nous faut pouvoir intégrer à la communication actuelle avec les riverains, en particulier l’aspect instantané.

Ensuite se pose la question : qui doit communiquer, quand ? Nous ne sommes plus dans une communication telle qu’on a pu connaître précédemment, ou finalement la première information à laquelle le grand public avait accès était le soir au journal télévisé.

Aujourd’hui, nous devons choisir les bons modes de communication, les bonnes cibles, et préparer, répertorier les informations, pour les utiliser efficacement.

Propos recueillis par Pierre Thouverez

Crédits image de une : Annie Gozard

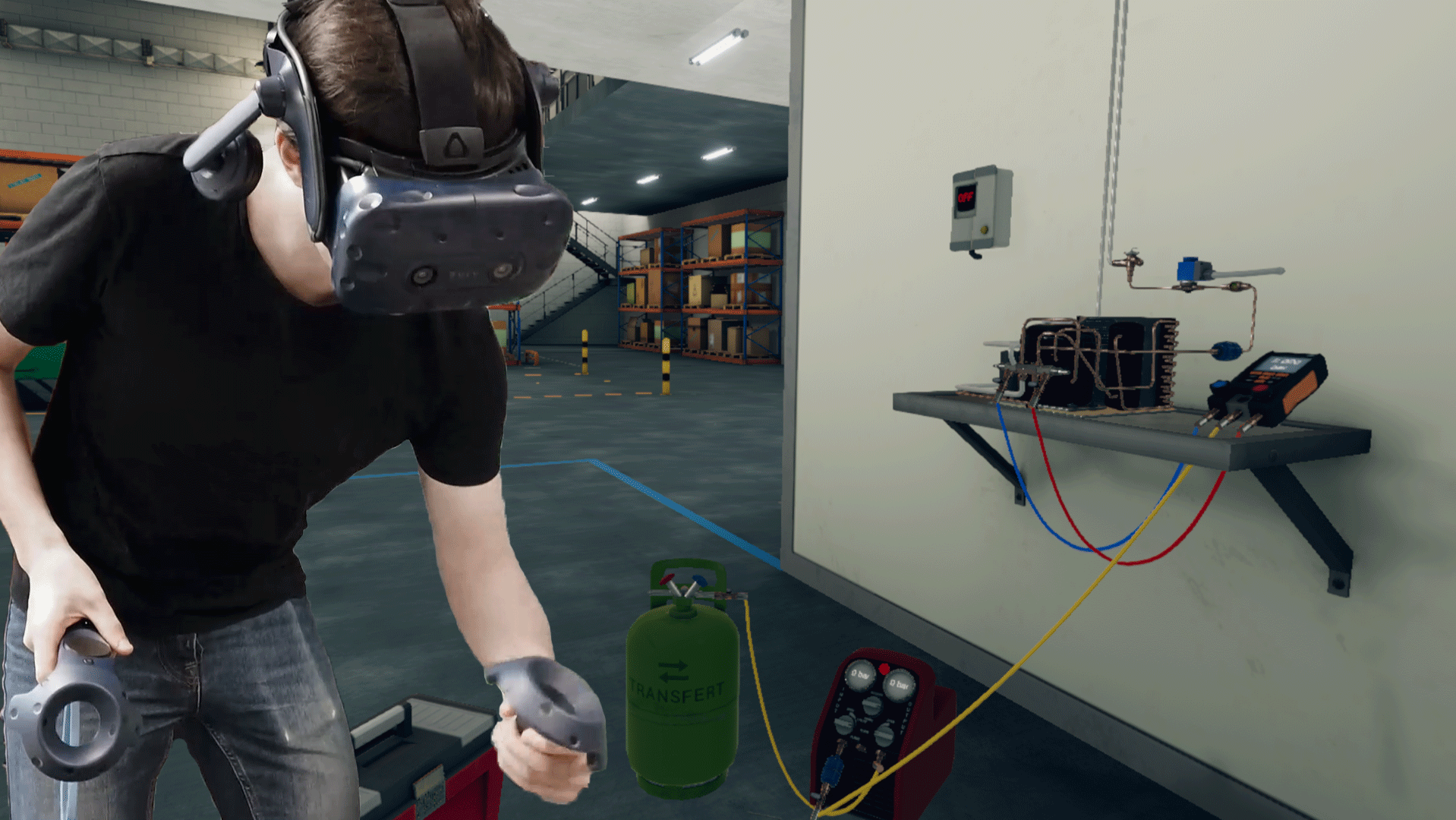

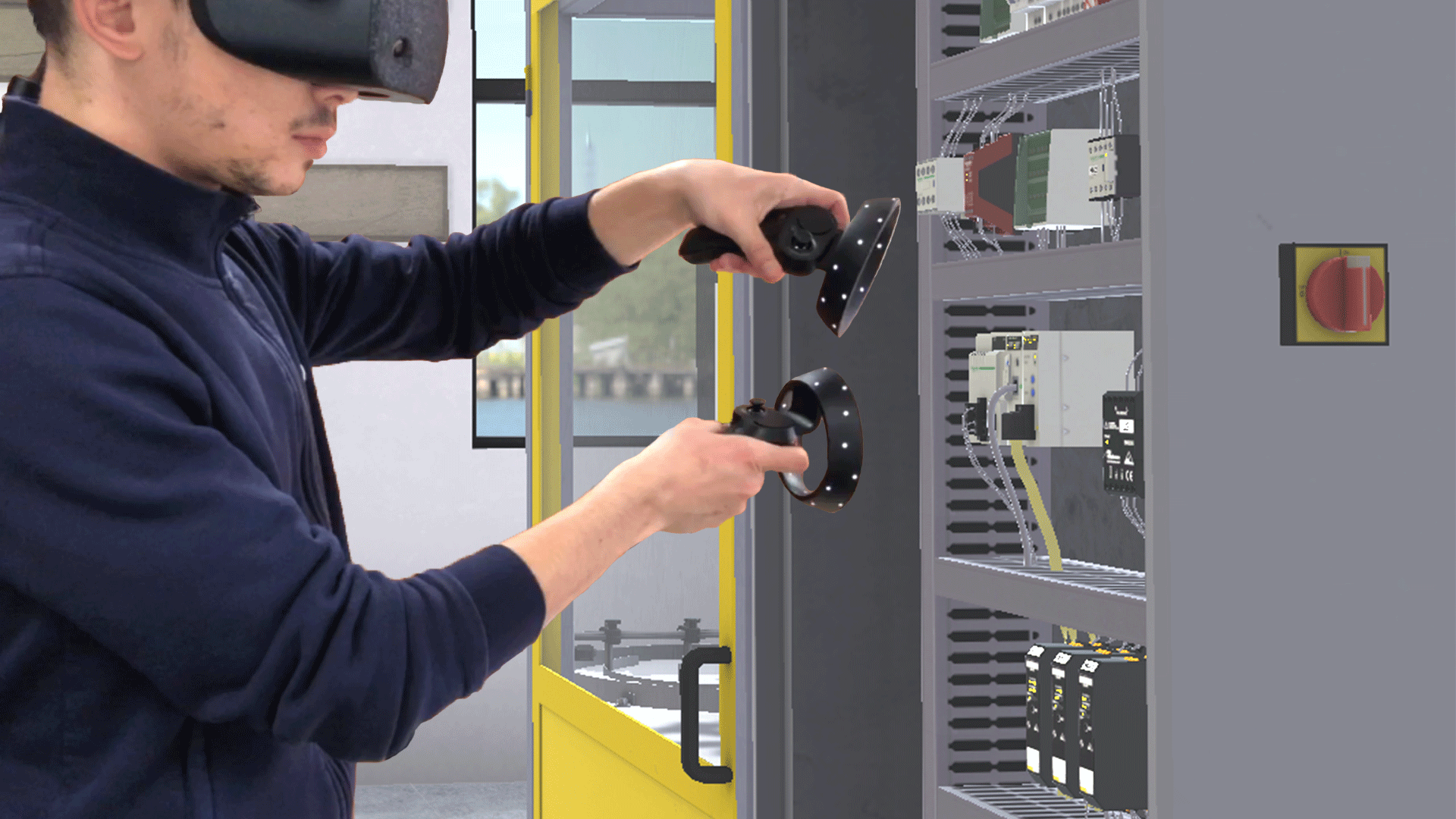

Laurent Da Dalto : En 2001, j’ai rencontré un professeur de l’AFPA [Agence nationale pour la

Laurent Da Dalto : En 2001, j’ai rencontré un professeur de l’AFPA [Agence nationale pour la