Le secteur de la construction consomme à lui seul près de la moitié des matières premières utilisées en Europe et produit un tiers de nos déchets. Bien que le taux de recyclage des déchets de construction et de démolition dans le béton atteigne à peine quelques pour cent, certains pays d’Europe du Nord-ouest – dont la France – dépassent les 70 % de recyclage de ces déchets, notamment pour du remblaiement ou le soubassement des chaussées.

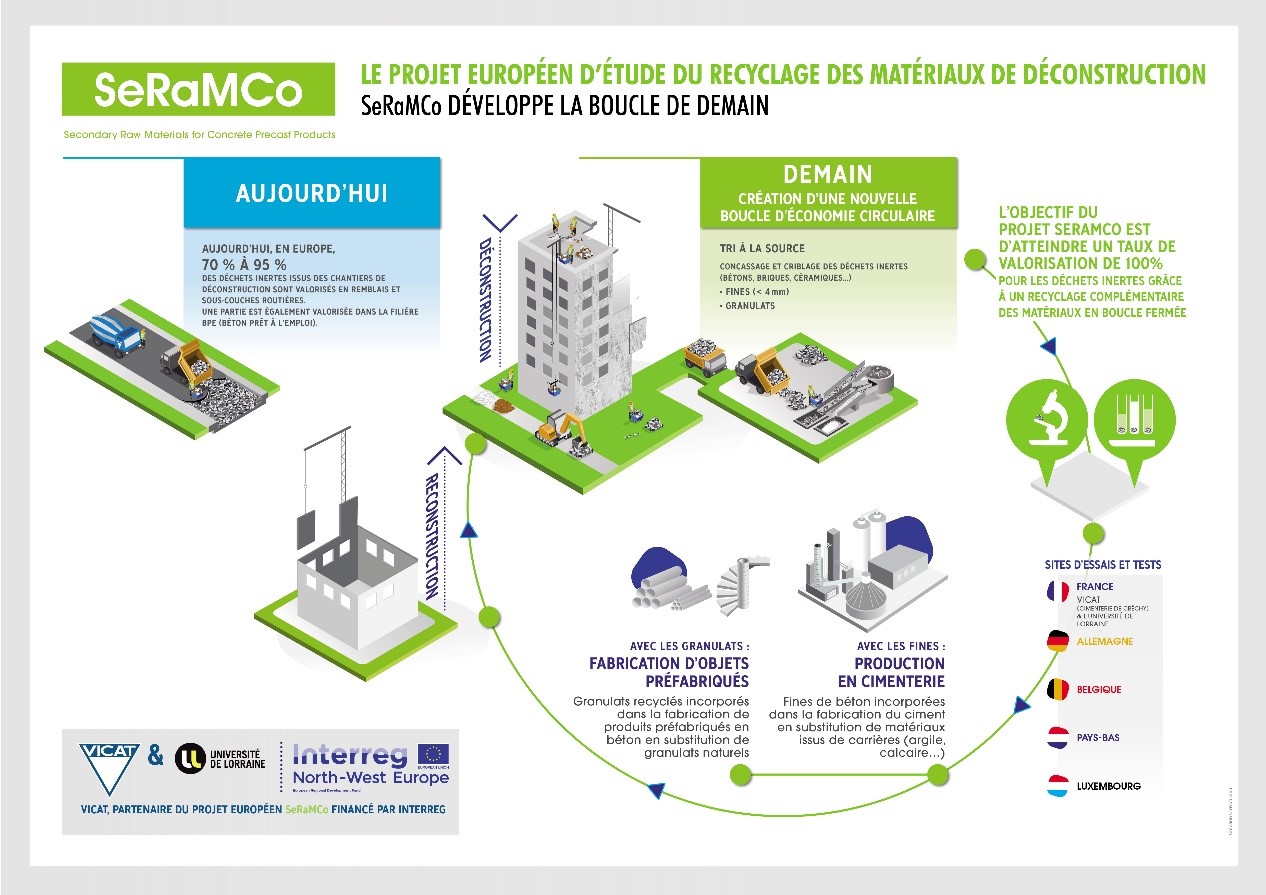

Porté par des acteurs universitaires et industriels de la construction français, allemands, belges, luxembourgeois et néerlandais, le projet SeRaMCo (Secondary Raw Materials for Concrete Precast Products) fait partie du programme INTERREG « Europe du Nord-Ouest », dont l’ambition est de faire de cette région un acteur économique de premier plan sur la scène mondiale. L’institut Jean Lamour (CNRS – Université de Lorraine) a participé à ce projet dans le cadre du développement de nouveaux mélanges de ciment à partir de granulats fins recyclés. Le projet SeRaMCo a été financé par l’UE à hauteur de 4,3 M€, sur un budget total de 7,2 M€.

Techniques de l’Ingénieur : Quel est le contexte derrière le projet SeRaMCo ?

Romain Trauchessec : Le principal objectif de SeRaMCo était de trouver de nouveaux débouchés aux granulats recyclés, en leur donnant le maximum de valeur sur le marché, afin d’éviter l’enfouissement et ainsi préserver les ressources naturelles.

André Lecomte : De notre point de vue, ce projet vient compléter le programme national RECYBÉTON, auquel nous avons également participé et qui peut être considéré comme précurseur. Ce projet conséquent, qui s’est déroulé entre 2012 et 2018, a regroupé la majorité des acteurs français de la filière – 47 partenaires – et fait l’objet de nombreuses publications concernant les propriétés des granulats recyclés, la durabilité des bétons et les impacts environnementaux. Un ouvrage de plus de 800 pages regroupant les recommandations du projet a également été réalisé.

Le projet SeRaMCo a un périmètre plus restreint, car il concerne uniquement la fabrication de produits préfabriqués à partir de granulats recyclés.

Quels sont les freins au recyclage des déchets de béton ?

A.L. : Il y a plusieurs freins au recyclage des déchets de béton. D’une part, les granulats de béton recyclé sont beaucoup plus poreux. Ils absorbent donc plus d’eau et ont des propriétés mécaniques moins intéressantes que les granulats naturels. C’est pour ces raisons que les normes actuelles recommandent de limiter l’ajout de gravillons recyclés dans les bétons. Selon la classe d’exposition et la qualité du granulat recyclé, le taux d’incorporation maximal recommandé des gravillons varie ainsi de 0 à 50 %.

D’autre part, pour que l’incorporation de granulats recyclés soit intéressante, tant du point de vue économique qu’environnemental, ceux-ci doivent provenir d’un chantier voisin, afin de réduire le transport à 20 ou 30 km maximum, ce qui limite encore leur utilisation.

Par ailleurs, la déconstruction et le concassage produisent une forte proportion de sable et de particules fines qui à l’heure actuelle sont peu valorisés. Ces fractions contiennent des éléments « polluants » pour les bétons (argiles, plâtre ou bois par exemple), mais aussi une forte proportion de l’ancien ciment. Dans ce projet, l’Institut Jean Lamour a donc cherché à refaire du ciment, à partir de ce co-produit.

R.T. : L’intérêt de recycler dépend aussi fortement du marché local. Ainsi, au Luxembourg, il y a de nombreux chantiers et le besoin en matériaux de construction est énorme. Comme la ressource naturelle en granulats est épuisée, il est facile de trouver des débouchés aux granulats recyclés. À Strasbourg, la situation est totalement différente, car la vallée du Rhin fournit des quantités industrielles de granulats naturels.

Avez-vous obtenu des résultats satisfaisants ?

R.T. : L’incorporation de 5 à 15 % de ces poudres de déconstruction dans le cru cimentier, nous permet de reformer un nouveau ciment après cuisson à 1 400-1 500°C, car les éléments chimiques se recombinent. Les différents essais qui ont été conduits, que ce soit au sein de l’institut Jean Lamour ou par Vicat, notre partenaire industriel, ont démontré que les propriétés de ce ciment recyclé étaient tout à fait conformes au produit standard.

Bien que cela consomme de l’énergie, le fait de recuire la matière a l’avantage de permettre l’élimination des particules « polluantes » par recombinaison des éléments chimiques. En effet, les déchets de déconstruction ont tendance à, par exemple, inclure du plâtre. Or le plâtre contient une forte proportion en sulfates solubles, ce qui peut être néfaste au ciment. Même si elle a des inconvénients (encroûtement potentiel du four, émissions de SO2), la cuisson permet ainsi de recombiner ces sulfates et de contrôler leur teneur.

L’ajout de poussières de déconstruction, directement dans le béton, donc sans recuit, a également été testé, mais les résultats n’ont pas été très concluants, pour les raisons que nous venons d’évoquer.

Quels étaient les autres volets du projet SeRaMCo ?

A.L. : En parallèle de ces travaux, nos partenaires ont travaillé sur d’autres aspects du recyclage du béton. Nos collègues de l’Université de Technologie de Delft (Pays-Bas) ont par exemple travaillé sur l’optimisation des produits et le développement de produits innovants en exploitant les propriétés particulières des granulats de déconstruction. De leur côté, nos collègues belges ont étudié le traitement des déchets de déconstruction et nos collègues allemands et luxembourgeois ont travaillé sur la formulation de mélanges.

Si vous désirez approfondir le sujet, nous vous invitons à consulter le rapport final du projet SeRaMCo, disponible sur le site du programme INTERREG. Les travaux conduits par l’Institut Jean Lamour sont détaillés des pages 116 à 133.